- Alibaba vừa open-source Qwen3.6-27B dưới Apache 2.0 — một mô hình dense 27B tích hợp sẵn vision encoder, xử lý ảnh/video/text trong một checkpoint duy nhất, và đánh bại cả bản MoE 35B-A3B ở gần như mọi benchmark coding, reasoning lẫn VLM.

TL;DR

Ngày 22/04/2026, Alibaba chính thức open-source Qwen3.6-27B trên Hugging Face và ModelScope dưới giấy phép Apache 2.0. Đây là bản dense 27B đi kèm của dòng Qwen3.6, ra mắt chỉ 6 ngày sau bản MoE 35B-A3B. Điểm đáng chú ý: mô hình natively multimodal — vision encoder tích hợp sẵn trong checkpoint, hỗ trợ cả thinking và non-thinking mode, xử lý ảnh/video song song với text. Kết quả benchmark: 27B dense vượt 35B-A3B trên gần như mọi bài kiểm tra, đặc biệt SWE-bench Verified 77.2 và AIME 2026 94.1.

What's new

Qwen3.6-27B là bản dense cùng họ với Qwen3.6-35B-A3B (MoE, 3B active params). Cả hai chia sẻ cùng một paradigm: một checkpoint duy nhất, bật/tắt thinking mode tuỳ task, và xử lý multimodal (text + image + video) ngay trong kiến trúc gốc thay vì bolt-on vision adapter.

- Kiến trúc hybrid: 64 layer, hidden dim 5,120, xen kẽ

Gated DeltaNet(linear attention) vớiGated Attentiontruyền thống. Layout 16 × (3 × DeltaNet + 1 × Full attention) giúp cân bằng tốc độ và chất lượng. - Context 262K native, mở rộng đến 1M token qua YaRN — vừa đủ để đọc nguyên một codebase hoặc xem full video dài.

- Thinking Preservation (tính năng mới): giữ lại reasoning trace từ các lượt chat trước, tái dùng trong multi-turn agent workflow, tiết kiệm token và duy trì chain-of-thought mạch lạc.

- Vision + Video: vision encoder cho phép input ảnh/video (fps sampling cấu hình được), không cần external VLM adapter.

Why it matters

Từ trước đến nay dòng Qwen-VL và dòng Qwen-text là hai nhánh riêng, buộc developer chọn giữa "mô hình text mạnh" hoặc "mô hình multimodal khá". Qwen3.6 xoá bỏ lựa chọn đó: một checkpoint duy nhất cover cả agentic coding (SWE-bench top-tier) lẫn visual reasoning (MMMU 82.9, MathVista 87.4).

Điểm đặc biệt là 27B dense beat 35B-A3B ở đa số benchmark. Điều này ngược với xu hướng MoE "to hơn luôn tốt hơn": với dense 27B, toàn bộ tham số active mỗi bước inference, trade-off memory lấy quality. Với team có GPU đủ VRAM, 27B dense là lựa chọn tốt hơn hẳn.

Technical facts

| Thông số | Qwen3.6-27B | Qwen3.6-35B-A3B |

|---|---|---|

| Kiểu kiến trúc | Dense | MoE (3B active) |

| Total params | 27B | 35B |

| Hidden dim / Layers | 5,120 / 64 | 5,120 / 64 |

| Context native | 262,144 | 262,144 |

| Context tối đa (YaRN) | ~1,010,000 | ~1,010,000 |

| Modalities | text + image + video | text + image + video |

| Thinking mode | ✓ (default) | ✓ (default) |

| Preserve Thinking | ✓ | ✓ |

| License | Apache 2.0 | Apache 2.0 |

Recommended sampling cho thinking mode: temperature=1.0, top_p=0.95, top_k=20. Cho precise coding: hạ temperature=0.6. Cho non-thinking instruct: temperature=0.7, top_p=0.8, presence_penalty=1.5.

Comparison

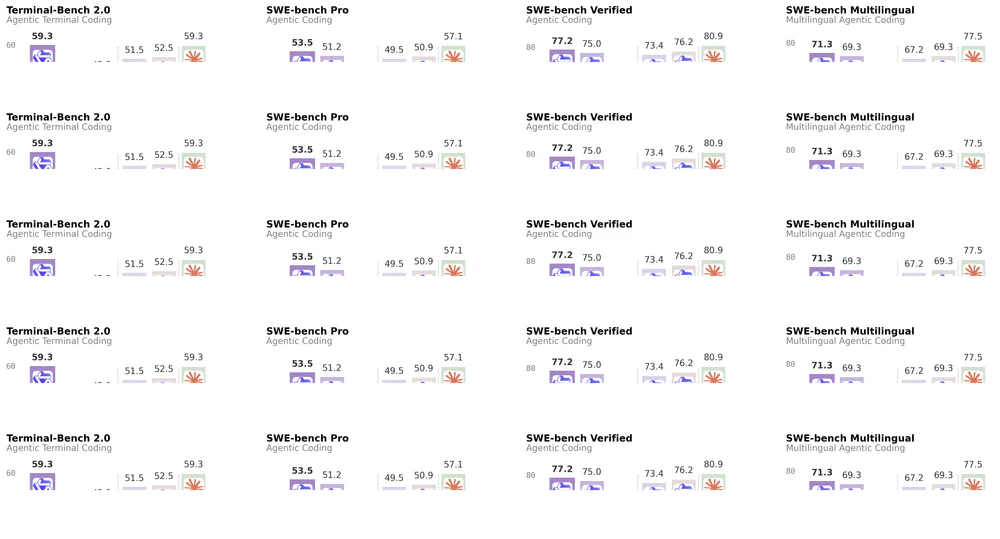

Dưới đây là đối đầu trực tiếp trên các benchmark đại diện (số càng cao càng tốt):

| Benchmark | Qwen3.6-27B | Qwen3.6-35B-A3B | Qwen3.5-27B |

|---|---|---|---|

| SWE-bench Verified | 77.2 | 73.4 | 75.0 |

| SWE-bench Pro | 53.5 | 49.5 | 51.2 |

| Terminal-Bench 2.0 | 59.3 | 51.5 | 41.6 |

| SkillsBench Avg5 | 48.2 | 28.7 | 27.2 |

| LiveCodeBench v6 | 83.9 | 80.4 | 80.7 |

| AIME 2026 | 94.1 | 92.7 | 92.6 |

| MMLU-Pro | 86.2 | 85.2 | 86.1 |

| GPQA Diamond | 87.8 | 86.0 | 85.5 |

| MMMU (VLM) | 82.9 | 81.7 | — |

| VideoMME (w/ sub) | 87.7 | 86.6 | — |

| AndroidWorld | 70.3 | — | — |

Điểm gây sốc nhất: SkillsBench Avg5 48.2 vs 28.7 — chênh gần 20 điểm. SkillsBench đo năng lực agent giải task đa bước phức tạp, nên con số này cho thấy 27B dense khá vượt trội về agentic capability khi full params được activate. Terminal-Bench 2.0 cũng nhảy từ 41.6 (Qwen3.5) lên 59.3 — generation leap thực sự trong một version bump.

Use cases

- Agentic coding assistant: SWE-bench 77.2 + Terminal-Bench 59.3 đưa mô hình vào nhóm có thể tự fix bug repo-level và điều khiển shell/CLI.

- GUI / mobile automation: AndroidWorld 70.3 cộng vision encoder → agent tương tác màn hình Android, tự động hoá thao tác app.

- Visual coding: input screenshot UI → generate functional frontend code (tính năng được Qwen team nhấn mạnh cho cả dòng 3.6).

- Document & video reasoning: context 262K + video input → phân tích báo cáo tài chính dài, đọc bản thiết kế, tóm tắt meeting recording, parsing invoice.

- Self-host cho enterprise: Apache 2.0 cho phép thương mại hoá. 27B dense chạy được trên 2×A100 80GB BF16, hoặc 1×H100 với quantization FP8, đủ cho team tự host trong môi trường private data.

Limitations & pricing

- Memory overhead: dense 27B luôn activate toàn bộ tham số → VRAM nhiều hơn 35B-A3B (chỉ activate 3B). Khoảng 54GB BF16, 27GB FP8.

- Context tối thiểu: team khuyến nghị giữ ít nhất 128K context khi bật thinking mode để tránh reasoning bị cắt giữa chừng.

- Preserve thinking token cost: tính năng mới giữ reasoning trace qua nhiều lượt có thể inflate tổng token, cần theo dõi khi chạy agent chain dài.

- Giá API: self-host miễn phí (Apache 2.0). Giá qua DashScope, OpenRouter hay Together AI chưa công bố ngày ra mắt; các bên này thường list trong 24–48h.

What's next

Qwen đã hint về các variant nhỏ hơn (khả năng 4B/8B/14B) trong dòng 3.6, cũng như một nhánh Qwen3.6-VL chuyên biệt cho vision. Hệ sinh thái inference day-1: vLLM, SGLang, Unsloth, MLX và Ollama đều có support. Đồng thời với Qwen3.6-Plus (bản closed flagship, 1M context) đã ra mắt đầu tháng 4/2026, Qwen team đang đẩy mạnh hướng agentic coding + multimodal reasoning thành trụ chính của thế hệ 3.6.

Nguồn: HuggingFace Qwen3.6-27B, QwenLM/Qwen3.6 GitHub, @Alibaba_Qwen, MarkTechPost.