- Hugging Face nhét toàn bộ tri thức setup robot SO-101, thu dữ liệu và chọn policy theo VRAM vào một file AGENT_GUIDE.md.

- Claude Code, Cursor, Copilot đọc xong là có thể hướng dẫn bạn từ A–Z.

- Không cần PhD, chỉ cần hỏi.

TL;DR

Ngày 22/04/2026, team LeRobot của Hugging Face công bố trên X rằng repo huggingface/lerobot giờ đã ship sẵn file AGENT_GUIDE.md — một hướng dẫn viết riêng cho AI coding agent (Claude Code, Cursor, Copilot…). Nó dạy agent toàn bộ insight cần để giúp user setup robot SO-101, thu dữ liệu demo cho tốt, và chọn policy phù hợp với GPU của user. Thông điệp thẳng thắn: "Reproducing it shouldn't take a PhD. Just ask!"

Có gì mới

AGENT_GUIDE.md xuất hiện trong repo LeRobot v0.5.1 (release 07/04/2026) dưới dạng file markdown ngay ở root. Nó không phải README cho người — nó là "brief" cho AI agent. Khi Claude Code hay Cursor mở repo, agent sẽ đọc file này và có ngay context để hướng dẫn bạn làm bất cứ điều gì từ flash motor đến train policy.

File được cấu trúc quanh 3 quickstart path rõ ràng:

- Path A — bạn có robot SO-101 thật, muốn train policy đầu tiên.

- Path B — bạn chưa có phần cứng, muốn train trên dataset có sẵn ở Hugging Face Hub.

- Path C — bạn đang khám phá codebase, muốn hiểu kiến trúc.

Trước khi gợi ý bất kỳ bước nào, guide buộc agent phải hỏi user 5 câu: mục tiêu, phần cứng sẵn có, cấu hình máy train, skill level, và dataset đã có chưa. Không còn kiểu "chạy lerobot-train đi" mà không biết user có GPU gì.

Vì sao điều này đáng chú ý

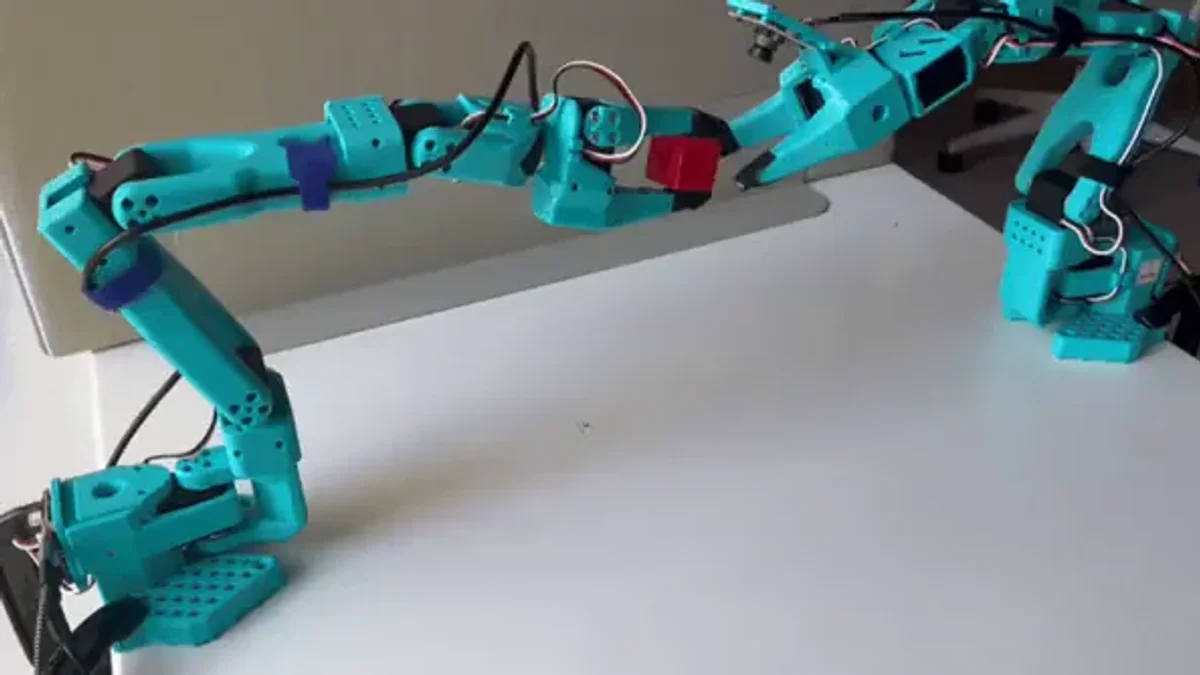

Bối cảnh: project mở nguồn Unfolding Robotics — robot SO-100 bimanual gấp áo thun — đã chứng minh home-lab imitation learning là có thể. Tại LeRobot Worldwide Hackathon, một team trẻ ở San Jose chỉ thu 50 episode và đạt 70% success rate gấp áo, sau đó lên 85% khi đổi policy. Nhưng để lặp lại ở nhà, user vẫn phải đọc xuyên 4–5 trang docs rời rạc (so101.mdx, il_robots, HIL-SERL, robot-learning-tutorial…) và hy vọng coding agent của mình có training data về LeRobot.

AGENT_GUIDE.md gom hết tri thức bộ tộc đó vào một file duy nhất. Kết quả: user chỉ cần gõ "giúp tôi train policy gấp áo" — agent sẽ biết phải hỏi gì, chạy lệnh nào, tránh lỗi phần cứng gì. Đây cũng là lần đầu một hãng lớn chính thức coi "AI agent là kênh onboarding" cho thư viện robot.

Số liệu kỹ thuật

Phần "ngon" nhất của guide là bảng profiling policy theo VRAM — thứ trước giờ chỉ có trong đầu maintainer:

| Policy | Peak VRAM | Phù hợp cho |

|---|---|---|

| ACT | 0.94 GB | Laptop, người mới, task đơn |

| SmolVLA | 3.93 GB | Task có instruction ngôn ngữ |

| Diffusion | 4.94 GB | Phân phối action multi-modal |

| π0 / π0.5 | 15–16 GB | VLA lớn, cần 24 GB+ GPU |

Decision rule guide đưa ra: <8 GB VRAM → ACT, 12–16 GB → SmolVLA, 24 GB+ → π0 hoặc GR00T N1.5. Đơn giản, không cần benchmark lại.

Về dữ liệu: 2 camera (front + wrist) ở 30 FPS, mỗi episode 20–45 giây, bắt đầu với 50 episode có ràng buộc rồi mới tăng đa dạng. Target: single-task grasp-and-place với 50 episode đạt >70% success bằng ACT, convergence dưới 50k step.

So sánh với trước và các stack khác

Trước AGENT_GUIDE.md, onboarding LeRobot là trò chơi ghép hình: bạn phải tự lẻo giữa docs, tự biết π0 sẽ OOM trên RTX 4070, tự đoán 50 episode có đủ không. Giờ file này đóng vai "compiler" biến câu hỏi tự nhiên thành đúng CLI.

So với stack đóng (NVIDIA GR00T, Google RT-2, Physical Intelligence π0.5 API), LeRobot vẫn là lựa chọn duy nhất mà phần cứng in 3D được, code Apache-2.0, và AI agent là kênh hỗ trợ chính thức. Chi phí phần cứng SO-101: ~130 USD nếu tự mua linh kiện và in, 220–240 USD nếu mua kit Seeed Studio / Hiwonder / WowRobo, cộng thêm ~35 USD nếu thuê in 3D.

Ai hưởng lợi

- Hobbyist & student muốn có con robot đầu tiên biết pick-and-place — giờ coding agent sẽ cầm tay qua cả calibration lẫn training.

- Giáo viên robotics cần material ổn định cho lớp học — AGENT_GUIDE.md chuẩn hoá quy trình.

- Hackathon team muốn clone lại demo gấp áo 85% success — có roadmap rõ ràng: 50 episode, ACT/SmolVLA, 5–10 epoch.

- Researcher solo không có robot — path B cho phép train trên dataset Hub thuần.

Giới hạn & chi phí

AGENT_GUIDE.md miễn phí, Apache-2.0. Nhưng robot thật thì không tự lắp được: motor vẫn phải flash ID vào EEPROM một lần bằng tay, calibration leader-follower vẫn cần thao tác vật lý. Guide cảnh báo thẳng: "Most 'timeout' errors are physical, not code" — debug phần mềm trong khi dây cáp lỏng là lỗi #1 của người mới.

Thêm nữa: π0 ~15–16 GB VRAM sẽ không fit trên hầu hết GPU gaming, nên dù guide liệt kê nó, người mới vẫn bị đẩy về ACT. Và triết lý không thay đổi: "Good data beats clever models" — 50 episode rác train policy xịn cũng fail.

Sắp tới

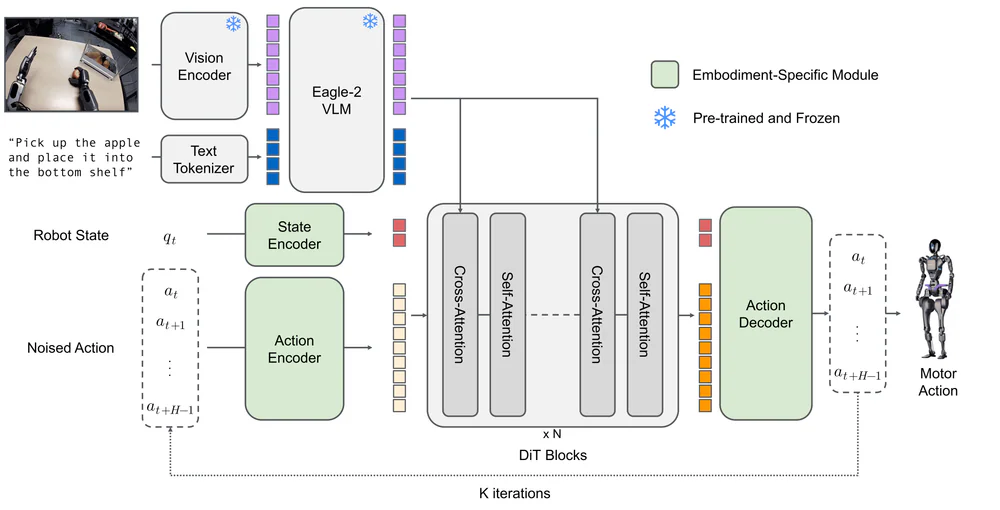

Hugging Face báo hiệu sẽ mở rộng AGENT_GUIDE.md sang workflow reinforcement learning HIL-SERL, thêm công thức fine-tune GR00T N1.5, và tích hợp sim-to-real qua NVIDIA Isaac. Với paper LeRobot tại ICLR 2026 đã được công bố, xu hướng rõ: kit phần cứng giá hobby + policy VLA tiên tiến + AI agent làm HLV — là bộ ba đang định nghĩa lại cách người bình thường vào robotics.

Nguồn: AGENT_GUIDE.md, SO-101 docs, Unfolding Robotics, @LeRobotHF.