- Một Go binary duy nhất dựng được lưới tính toán AI phi tập trung trên libp2p: đóng gói agent bằng Podman, publish lên mesh, và để bất kỳ Boss node nào gọi task qua tunnel mã hóa end-to-end.

- Không cloud, không API key, không egress.

TL;DR

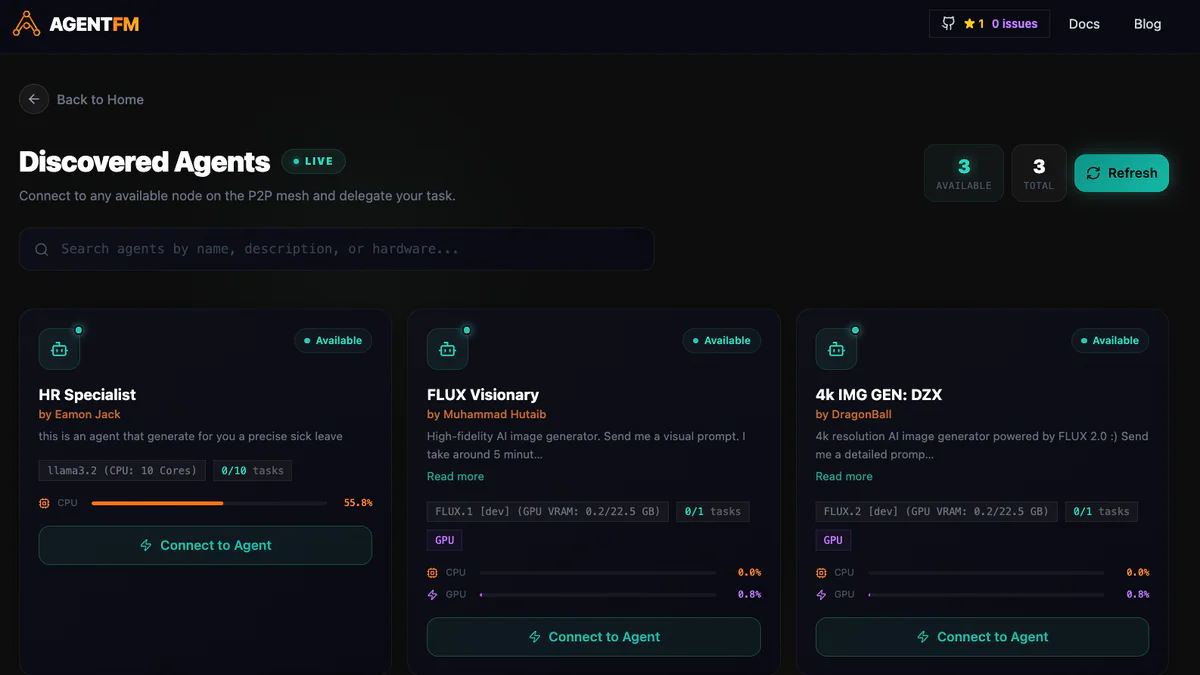

AgentFM là một binary Go (v1.1.0, Apache-2.0) biến CPU/GPU rảnh thành lưới siêu máy tính AI phi tập trung. Bạn đóng gói AI agent thành Podman container, quảng bá nó lên mesh libp2p, và bất kỳ Boss node nào trên mạng cũng có thể dispatch task tới bạn qua tunnel TCP mã hóa end-to-end. Không cloud, không API key, không data egress — chi phí $0 / triệu token. Tác giả gọi nó là "SETI@Home, nhưng dành cho AI".

Có gì mới

AgentFM vừa phát hành v1.1.0 cách đây vài ngày. Điểm khác biệt so với loạt dự án "P2P compute" đã có:

- Zero-config NAT traversal: dùng libp2p AutoNAT + Kademlia DHT + mDNS + Circuit Relay v2 để xuyên router, firewall doanh nghiệp, hotspot di động mà không cần mở port.

- Sandbox ephemeral: mỗi task spawn 1 Podman container daemonless, container chết ngay khi stream kết thúc — hoặc khi tunnel drop (SIGKILL trong 2 giây).

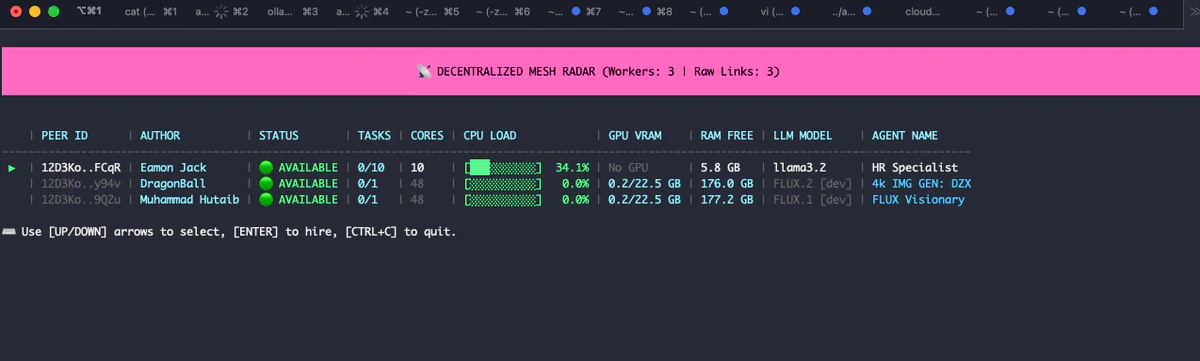

- Telemetry radio: mỗi Worker broadcast CPU / GPU VRAM / queue state qua GossipSub mỗi 2 giây. Overloaded node tự chuyển sang trạng thái 🔴 BUSY và từ chối task.

- Enterprise darknet: flag

-swarmkeybiến mesh public thành mạng PSK-encrypted riêng, peer không có key thấy traffic như ciphertext rác ngay ở layer TCP. - Headless API gateway: Boss chạy mode API expose HTTP endpoints tại

:9090, trigger task P2P từ Next.js, n8n, Slack bot hay Python SDK.

Vì sao quan trọng

Chạy AI workload nghiêm túc hôm nay bị kẹt giữa ba lựa chọn tệ: thuê GPU cloud (đắt, rate-limited, data rời khỏi network), mua GPU riêng (~$2.000 capex, idle 90% thời gian), hoặc chạy local trên laptop (đủ cho đồ chơi, không đủ VRAM cho thứ nghiêm túc). AgentFM đề xuất con đường thứ tư: gom chính những GPU đang idle đó thành một lưới chia sẻ. Một GPU cloud session hiện tốn $0.50–$1.00/giờ; lưới P2P có thể cắt chi phí compute xuống ~50% trong các setup phân tán, theo ghi nhận của các hệ tương tự.

Technical facts

- Ngôn ngữ: Go 1.25+ (77.8% codebase), Python SDK (14.1%).

- Networking: libp2p — cùng stack với IPFS, Ethereum, Filecoin. Peer ID là Ed25519 public key, không phải IP — Worker đổi Wi-Fi thì mesh tự rediscover.

- Transport: TCP + Noise/TLS (QUIC trong roadmap).

- Runtime container: Podman daemonless, rootless. Chỉ Worker cần Podman; Boss và Relay thì không.

- Giới hạn task: JSON envelope ≤1MB qua

io.LimitReader;TaskExecutionTimeout10 phút; artifact zip stream qua protocol riêng/agentfm/artifacts/1.0.0. - Circuit breakers:

-maxtasks,-maxcpu,-maxgpu— Worker tự từ chối task khi vượt ngưỡng. - GPU aware: auto-attach

nvidia.com/gpu=allnếu phát hiệnnvidia-smi. - Cross-platform: macOS, Linux, Windows × amd64/arm64. One-line installer cho macOS/Linux.

So sánh

Bảng so sánh theo README chính thức:

| Tiêu chí | AgentFM | OpenAI/Anthropic API | AWS SageMaker / RunPod | Ollama local |

|---|---|---|---|---|

| Data không rời peer group | ✅ | ❌ | ❌ | ✅ |

| Multi-machine compute | ✅ | n/a | ✅ | ❌ |

| Chạy mọi framework/container | ✅ | ❌ | ✅ | ❌ |

| Chạy sau NAT không port-forward | ✅ | n/a | n/a | ❌ |

| Cost / triệu token | $0 | 💸💸💸 | 💸💸 | $0 |

| Private swarm cho enterprise | ✅ | ❌ | Partial (VPC) | n/a |

| Thời gian setup | ~2 phút | API key | ngày | phút |

Use cases

- Indie AI dev muốn chạy Llama 3.2 hoặc FLUX image gen nhưng laptop không đủ VRAM — mượn RTX 4090 của bạn.

- Researcher cần scale inference sang nhiều node mà không trả tiền RunPod.

- Team nội bộ có gaming PC ở nhà + workstation văn phòng + GPU server — gom tất cả thành một pool qua PSK-gated darknet, không lộ byte nào ra internet public.

- Tích hợp headless: Next.js app gọi

POST /api/execute→ Boss mở P2P tunnel → stdout stream về qua HTTP chunked encoding. n8n workflow và Python SDK đều first-class. - Batch fan-out: Python SDK

batch_execute()scatter-gather prompt list xuống nhiều Worker, lọc theo model với retry và per-worker capacity cap.

Limitations & pricing

- Giá: miễn phí, Apache-2.0. Chi phí duy nhất là ~$5/tháng VPS (Hetzner, DigitalOcean, Fly) nếu bạn muốn chạy Relay riêng cho darknet.

- Sandbox isolation không đầy đủ: Podman

--network hostcho process + filesystem + user-namespace isolation, nhưng không có network isolation và không có kernel-level isolation. Threat model cần isolation kernel phải wrap AgentFM trong gVisor / Kata / Firecracker VM. - Prompt không được bảo vệ trước Worker độc hại trên public mesh: README ghi rõ "treat your prompt as published". Muốn confidential — bắt buộc dùng private swarm.

- Phụ thuộc Relay: mesh public hoặc darknet cần VPS permanent giữ identity ổn định. Mất

relay_identity.key= mất address bootstrap. - Traction còn nhỏ: HN post chỉ 15 điểm / 2 comments, repo 66 stars, 8 forks. Vẫn là dự án sớm.

What's next

Roadmap chính thức chưa công bố chi tiết. Điểm rõ nhất là nâng transport từ TCP sang QUIC — tác giả đã viết sẵn contract "bidirectional authenticated byte stream to peer X" để dễ swap. Tor transport cũng được nhắc tới như lựa chọn tương lai. Nếu AgentFM chạm được critical mass, nó có thể định nghĩa lại economics của AI inference giống cách BitTorrent từng làm với distribution: compute thuộc về tất cả, không thuộc về 3 cloud provider.

Nguồn: GitHub Agent-FM/agentfm-core, PromptZone, Hacker News.