- Meta công bố Sapiens2 tại ICLR 2026 — model ViT 0.1B–5B params, resolution 1K/4K, pretrained trên 750M ảnh người.

- Cộng đồng gọi đây là 'first public release by a large lab that is non-trivial to replicate'.

- Pose +4 mAP, body-part seg +24.3 mIoU, normal error giảm 45.6%.

TL;DR

Sapiens2 là family vision transformer từ Meta Reality Labs (Codec Avatars group), phát hành công khai trên GitHub trong tháng 4/2026 sau khi được nhận poster tại ICLR 2026. Dòng model trải từ 0.1B đến 5B params, native hỗ trợ resolution 1K và biến thể hierarchical 4K, pretrained trên ~1 tỷ ảnh người (Humans-750M sau lọc từ pool ~4B ảnh web-scale).

Astrid Wilde gọi thẳng: "highest quality ViT backbone that now exists in the public domain... first public release by a large lab that is non-trivial to replicate." Với chi phí training ở quy mô này, đây đúng là public service cho cả lĩnh vực human-centric vision.

What's new

- Family 6 model: 0.1B / 0.4B / 0.8B / 1B / 1B-4K / 5B — patch size 16, train ở 1024×768 (trừ 1B-4K train ở 4096×3072).

- Objective pretraining lai: kết hợp Masked Autoencoder (MAE) cho chi tiết pixel + self-distilled contrastive loss cho semantics — mix tối ưu ở λ=0.6.

- Architecture hiện đại: RMSNorm thay LayerNorm, Grouped-Query Attention, QK-Norm (quan trọng nhất cho stability ở 5B), SwiGLU FFN, PixelShuffle decoder. 4K variant dùng windowed + global attention, output resolution 2K.

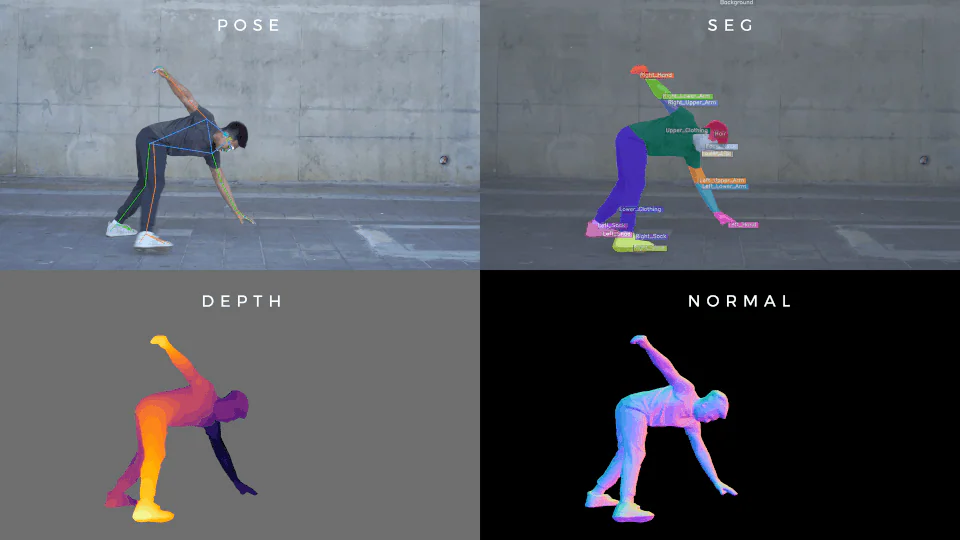

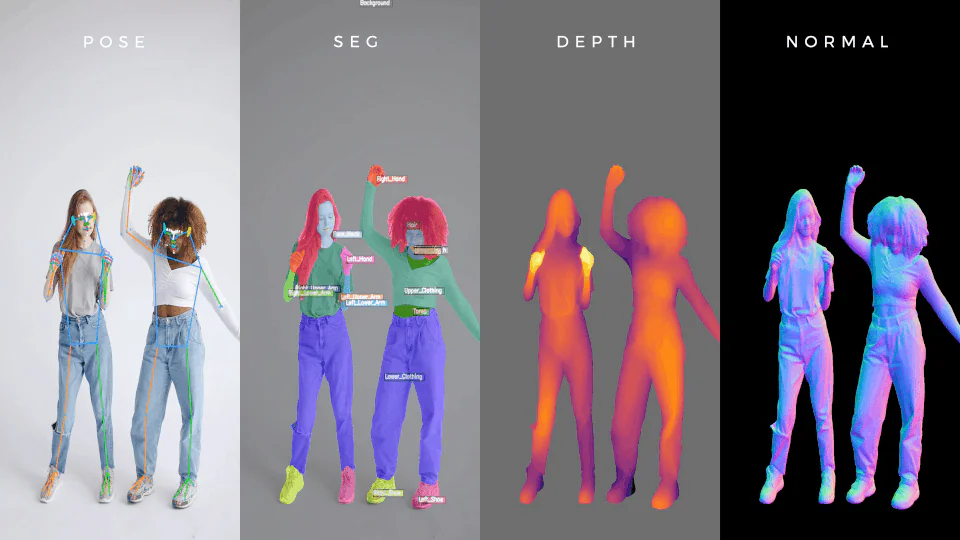

- Task mở rộng: ngoài 4 task cũ của Sapiens v1 (pose, segmentation, depth, normal), v2 thêm pointmap (geometry XYZ) và albedo estimation.

- Open source code + weights dưới "Sapiens2 License" tại facebookresearch/sapiens2. Dataset 750M ảnh KHÔNG release vì privacy.

Why it matters

Trước Sapiens2, lĩnh vực human-centric vision bị chia nhỏ: mỗi task một model chuyên biệt, mỗi lab training riêng trên dataset nhỏ. Các general backbone như DINOv2 mạnh nhưng không tối ưu cho người; các model human-specific thường không đủ quy mô để làm foundation.

Sapiens2 là bước đầu tiên từ một lab lớn, với compute + data scale đủ lớn để không reproduce được bởi team nhỏ — và họ release công khai. Cụ thể: 750M ảnh người đã được filter từ ~4B ảnh web-scale, training ở 1024×768 với 5B params là thứ mà ngay cả startup series B cũng khó đuổi theo. Việc Meta mở cho cộng đồng nghĩa là ai cũng có thể fine-tune 1 head nhẹ và bật lên các ứng dụng avatar, motion capture, virtual try-on, relighting — không cần training from scratch.

Technical facts

Bảng model card chính thức từ repo:

| Model | Params | TFLOPs | Embed | Layers | Heads |

|---|---|---|---|---|---|

| Sapiens2-0.1B | 0.114 B | 0.342 | 768 | 12 | 12 |

| Sapiens2-0.4B | 0.398 B | 1.260 | 1024 | 24 | 16 |

| Sapiens2-0.8B | 0.818 B | 2.592 | 1280 | 32 | 16 |

| Sapiens2-1B | 1.462 B | 4.715 | 1536 | 40 | 24 |

| Sapiens2-1B (4K) | 1.607 B | 6.43 | 1536 | 40 | 24 |

| Sapiens2-5B | 5.071 B | 15.722 | 2432 | 56 | 32 |

Ablation cho thấy hybrid objective thật sự quan trọng: ở 5M ảnh subset, MAE+CL đạt 18.9 mAP pose (vs 16.8 MAE-only, 13.3 CL-only). CL một mình thì bất lực cho dense prediction; MAE một mình thiếu semantics. Kết hợp là key design.

Về tốc độ: Sapiens2-5B xử lý 1024-res ảnh ở ~15.72 TFLOPs/ảnh, ngang ViT-22B ở 224 (11.36 TFLOPs), nhưng output dense cho ảnh 5× lớn hơn.

Comparison với Sapiens v1

| Axis | Sapiens v1 (ECCV 2024) | Sapiens2 (ICLR 2026) |

|---|---|---|

| Pretrain data | Humans-300M | Humans-750M (từ ~4B pool) |

| Objective | MAE only | MAE + self-distilled contrastive |

| Resolution | 1K native | 1K + 4K hierarchical (output 2K) |

| Model sizes | 0.3B–2B | 0.1B–5B |

| Task | pose, seg, depth, normal | + pointmap, albedo |

| Pose | baseline | +4 mAP |

| Body-part seg | baseline | +24.3 mIoU |

| Normal angular error | baseline | −45.6% |

Con số cụ thể: trên Hi4D normal estimation, Sapiens2-5B đạt 9.43 mean angular error (v1: 12.18, DaViD-Large: 15.37). Trên dense 308-keypoint in-the-wild, 5B đạt 82.3 mAP — SOTA mới. Zero-shot COCO-WholeBody, Sapiens2-1B đạt 57.9 mAP dù predict 308 điểm vs ViTPose++ chỉ 133 điểm.

Use cases

- Avatar creation & Codec Avatars — chính là motivation gốc của dự án ở Meta Reality Labs.

- 3D human digitization in-the-wild — 308 keypoint (243 là facial: mắt, môi, mũi, tai) đủ chi tiết cho biểu cảm không cần multi-view studio.

- Virtual relighting + material recovery — albedo tách được màu gốc khỏi lighting, cho phép chèn người vào môi trường ảo mới rồi relight.

- Motion capture / VFX film — surface normals + pointmap (XYZ) cho geometry chính xác.

- Virtual try-on fashion — 29-class segmentation phân biệt upper/lower limb, chi tiết môi trên/dưới.

- Gaming + AR — backbone frozen + head nhẹ cho real-time inference (với 0.1B–0.4B variants).

Tác giả note rõ: sweet spot là ảnh có 1–4 người nổi bật. Crowd scenes (stadium, street crowd) sẽ degrade.

Limitations & pricing

- Crowded scenes: hiệu năng giảm với >4 người — không ideal cho surveillance, sân bóng đông.

- Sim-to-real gap: pointmap, normal, albedo được train hoàn toàn trên synthetic data (scan RenderPeople). Có rủi ro gap với in-the-wild.

- Không đa dụng cho non-human: trên ADE20K / Cityscapes, Sapiens2 thua DINOv2 — model chuyên ngành, không phải general backbone.

- Color augmentation penalty: albedo mất ~5 dB PSNR khi dùng color jitter mạnh.

- License: code + weights dưới "Sapiens2 License" (research-friendly, không phải MIT/Apache). Paper là CC BY 4.0.

- Dataset 750M ảnh không public vì privacy — không thể reproduce pretraining.

- Requirements: Python ≥3.12, PyTorch ≥2.7. Forward pass standalone chỉ cần

torch+safetensors.

What's next

Trong rebuttal reviewer, tác giả xác nhận 3 hướng roadmap:

- AIGC synthetic data — thử dùng ảnh do generative model tạo để mở rộng domain coverage (body types, lighting, scene variety).

- Multi-person modeling — kiến trúc mới để xử lý crowd/multi-agent interactions hiệu quả.

- Scale data diversity — vượt qua bias "1–4 người nổi bật" hiện tại, thêm data đa dạng hơn.

Với việc Meta đã mở code + weights, khả năng cộng đồng build fine-tuned variants cho fashion, sports analytics, medical imaging sẽ bùng nổ trong 6 tháng tới. Nếu bạn đang làm avatar, motion capture, hoặc pose estimation — đây là backbone nên tích hợp ngay.

Nguồn: GitHub facebookresearch/sapiens2, OpenReview ICLR 2026, Meta Reality Labs Sapiens, Astrid Wilde.