- Schmidhuber và team KAUST/IDSIA biến co-design body+brain của robot thành một game leader-follower.

- Kết quả: robot tự tiến hoá thành tay đẩy hộp, chân di chuyển — vượt SoTA 20.66% trung bình, 32.02% trên task 3D phức tạp, dùng ít hơn 39% sample.

- Paper poster ICLR 2026 ngày 25/04.

TL;DR

Nhóm Yanning Dai, Yuhui Wang, Dylan R. Ashley và Jürgen Schmidhuber (KAUST + IDSIA/USI/SUPSI Lugano) công bố Stackelberg PPO tại ICLR 2026 — một cách reformulate bài toán morphology-control co-design (đồng thiết kế cấu trúc thân + chính sách điều khiển của robot) thành Stackelberg game: thân robot là leader, control policy là follower. Cho duy nhất reward là tốc độ đẩy hộp về phía trước, hệ thống tự tiến hoá robot có tay để đẩy và chân để di chuyển — không cần prior nào về morphology. Vượt SoTA +20.66% trung bình trên 9 môi trường, +32.02% trên 4 task 3D phức tạp, dùng ít hơn ~39% sample.

What's new

Co-design robot — tối ưu đồng thời thân và não — là bài toán cũ nhưng cực khó: hai phần cặp nhau qua một interface không khả vi (rebuild body trong simulator MuJoCo là rời rạc). Các phương pháp hiện tại (BodyGen, PPO co-design) coi control policy là tĩnh khi cập nhật morphology, dẫn tới gradient lệch và training bất ổn.

Stackelberg PPO làm 3 thứ mới:

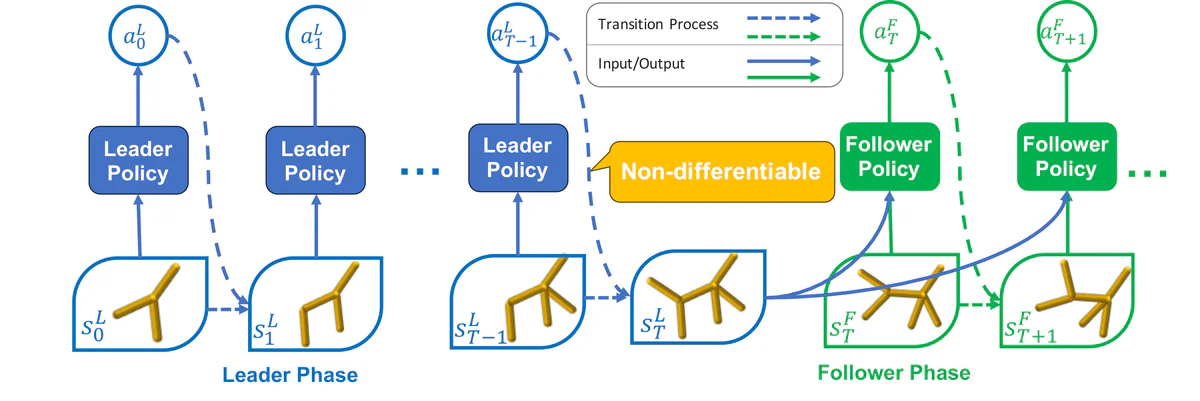

- Game-theoretic view: mô hình hoá coupling thành Stackelberg Markov Game phase-separated — leader đi trước, follower phản hồi.

- Stackelberg Implicit Differentiation: đạo hàm morphology gradient có tính cả việc control sẽ thích nghi sau khi body đổi, thay vì giả định cố định.

- Novel policy gradient cho Markov game có giao diện không khả vi, dùng Fisher information matrix để approximate — ổn định ~2 lần so với analytic gradient (6000 vs 2500 trên metric stability).

Why it matters

Embodied AI đang đi từ chỉ tối ưu policy sang tối ưu cả thân thể. Nếu robot có thể tự đề xuất hình dạng tối ưu cho task của nó, ta giảm hẳn công sức thiết kế cơ khí thủ công — đặc biệt cho soft robotics, robot mô-đun, hoặc embodied agent trong sim. Schmidhuber có lý do để tweet: đây là một bước rõ ràng hướng tới Darwinian RL — body và brain cùng tiến hoá theo gradient, không cần body library hard-coded.

Technical facts

| Property | Stackelberg PPO |

|---|---|

| Trung bình trên 9 envs | +20.66% so với BodyGen / PPO co-design |

| Trên 4 task 3D phức tạp (Pusher, Crawler, Stepper-Reg, Stepper-Hard) | +32.02% |

| Sample efficiency | ~39% ít sample hơn để đạt threshold |

| Stepper-Regular T=7 | 8260.74 ± 148.58 vs 6879.60 ± 175.41 |

| Stepper-Regular T=9 | 6739.51 ± 631.35 vs 3375.11 ± 486.54 (~2×) |

| Stability (Fisher vs analytic) | ~2× (6000 vs 2500) |

| Robust trên λ | [0.5, 10] |

| Stack | PyTorch 2.0.1, MuJoCo 2.1.0, Python ≥3.9 |

| License | MIT |

Comparison

| Khía cạnh | BodyGen / PPO co-design | Stackelberg PPO |

|---|---|---|

| Optimization | Single-level / đồng thời | Bi-level (leader=body, follower=control) |

| Control adaptation | Coi như cố định khi update body | Vi phân ngầm qua follower dynamics |

| Trung bình 9 envs | baseline | +20.66% |

| 3D tasks (4) | baseline | +32.02% |

| Stability | — | ~2× (Fisher approximation) |

Use cases

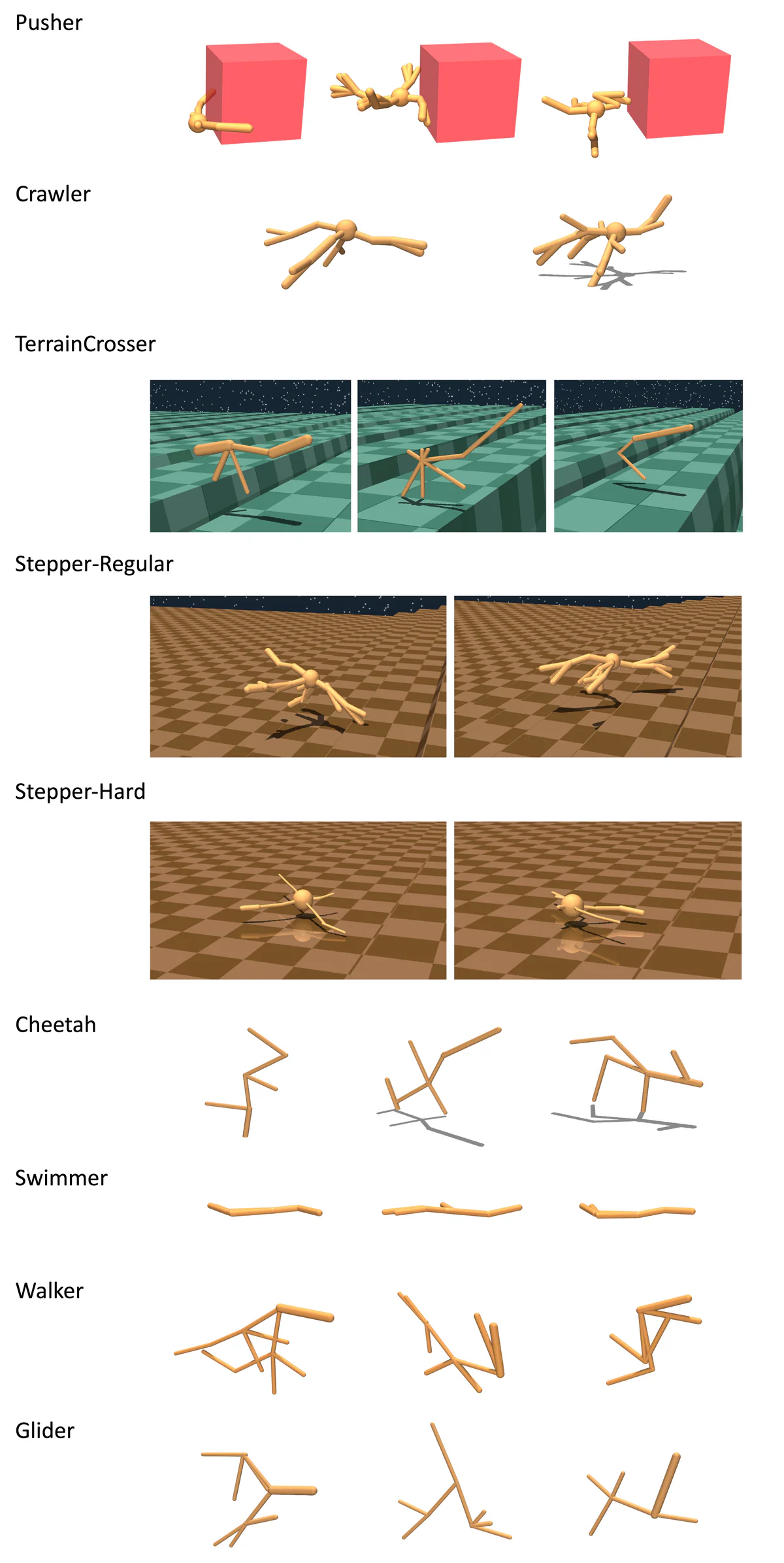

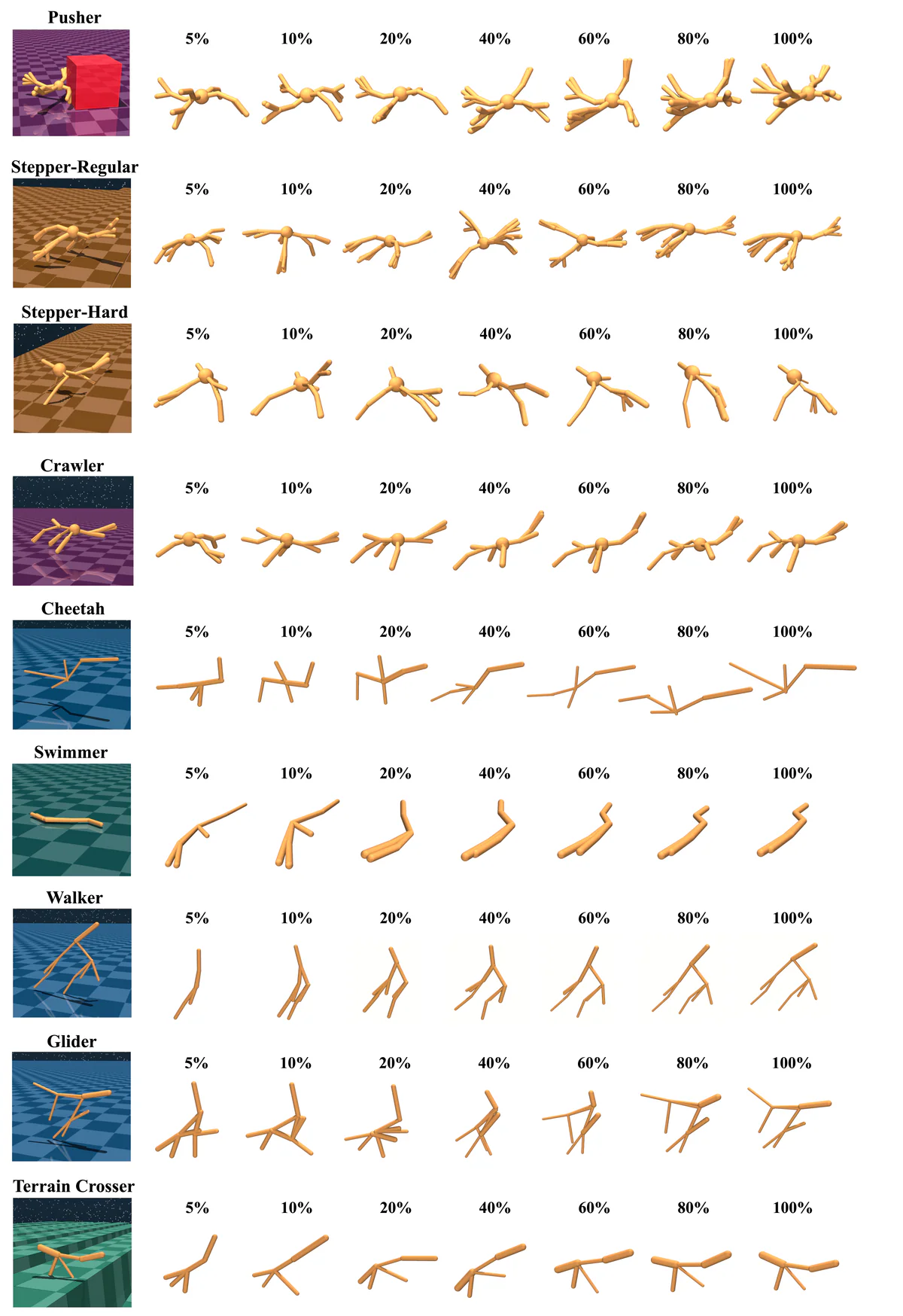

Trong paper, Stackelberg PPO chạy trên 13 môi trường MuJoCo: Pusher, Crawler, Stepper-Regular/Hard, Cheetah, Walker (3 biến thể), Glider (3 biến thể), Swimmer, TerrainCrosser. Ấn tượng nhất là specialization tự nhiên: với chỉ một reward "đẩy hộp đi xa", system không có khái niệm "tay" hay "chân" — vẫn tiến hoá ra robot có nhánh ngắn cứng để đẩy và nhánh dài để locomote. Cùng cơ chế, đặt vào Cheetah → ra dáng 4-chân chạy; vào Glider → ra dáng cánh.

Ý tưởng Stackelberg implicit differentiation cũng có thể vượt khỏi robotics: bất cứ bài toán bi-level RL nào có leader-follower coupling không khả vi — mech design, drug discovery, neural architecture search có downstream training — đều là ứng cử viên.

Limitations & pricing

- Free, MIT license — code mở tại YanningDai/StackelbergPPO.

- Yêu cầu Linux + MuJoCo + GPU — đây là codebase nghiên cứu, không phải sản phẩm one-click.

- Stackelberg implicit differentiation thêm overhead compute mỗi lần update leader.

- Chỉ thử trên rigid bodies dạng MuJoCo — soft robotics chưa được test.

- Ablation chỉ trên dải regularization λ; chưa benchmark trên real-world transfer.

What's next

Paper được present dạng poster P4-#4810 tại ICLR 2026, ngày 25/04 lúc 10:30 sáng. Hướng mở rộng tự nhiên: morphology phi-rigid (soft robots), không gian thiết kế lớn hơn, transfer sang phần cứng thật. Với việc Schmidhuber đứng tên, kỳ vọng có follow-up về co-evolution của body + memory + meta-learning.

Nguồn: arXiv 2603.15388, project page, OpenReview ICLR 2026, code.