- Anthropic vừa tung /ultrareview — slash command mới trong Claude Code, dispatch một fleet agent reviewer chạy song song trong cloud sandbox.

- Mỗi bug được agent độc lập reproduce trước khi báo về, false positive nội bộ dưới 1%.

- Trên PR lớn (>1.000 dòng), tỉ lệ tìm thấy bug là 84% với trung bình 7,5 issue.

TL;DR

Anthropic vừa ra mắt /ultrareview — slash command premium mới trong Claude Code, kích hoạt một fleet agent reviewer chạy song song trong remote cloud sandbox để săn bug ở branch hoặc pull request. Khác với /review chạy local single-pass, mỗi finding của /ultrareview đều được một agent độc lập reproduce lại trên code thật trước khi báo về session — giúp tỉ lệ false positive nội bộ Anthropic giữ dưới 1%. Trên các PR lớn hơn 1.000 dòng, hệ thống tìm ra bug ở 84% trường hợp, trung bình 7,5 issue mỗi PR. Mỗi review tốn 5–10 phút, giá $5–$20 (Pro/Max được 3 free run hết hạn 5/5/2026).

Có gì mới

Ngày 9/3/2026, Anthropic công bố Code Review — hệ thống multi-agent cloud chạy trên Claude Code on the web — và sau đó rollout phiên bản CLI dạng research preview tên /ultrareview cho người dùng Pro/Max trên Claude Code v2.1.86 trở lên.

Cách dùng đơn giản:

/ultrareview— review diff giữa branch hiện tại và default branch (kèm uncommitted/staged changes). Claude Code bundle repo state rồi upload lên sandbox./ultrareview 1234— clone trực tiếp PR #1234 từ GitHub vào sandbox để review (PR mode, cần repo có remote github.com).

Review chạy nền — bạn đóng terminal, làm việc khác đều OK; theo dõi qua /tasks. Khi xong, finding hiện ra dưới dạng notification kèm file/line + giải thích, sẵn sàng để bảo Claude "fix this".

Vì sao đáng quan tâm

Cat Wu — Head of Product của Claude Code — nói thẳng vấn đề: "Càng nhiều người xài Claude Code, số PR mở ra càng nhiều. Gánh nặng dồn về reviewer — chỉ cần một engineer + một prompt là có thể tạo ra một PR trông hợp lý, và reviewer phải bỏ thời gian verify từng edge case."

Số liệu nội bộ Anthropic minh hoạ rõ: code output trên mỗi engineer tăng 200% trong năm qua. Sau khi triển khai Code Review, tỉ lệ PR có review comment thực chất nhảy từ 16% lên 54%. Engineers giờ "hơi lo" khi không thấy comment từ Claude trên PR của mình.

Technical facts

| Property | Detail |

|---|---|

| Architecture | Fleet reviewer agents chạy song song trong cloud sandbox |

| Verification | Mỗi finding được independent agent reproduce trên real code trước khi báo |

| False positive (internal) | < 1% findings bị engineers mark incorrect |

| Runtime (CLI) | 5–10 phút mỗi run; trung bình toàn server ~20 phút |

| Hit rate — PR > 1.000 lines | 84% có findings, trung bình 7,5 issues |

| Hit rate — PR < 50 lines | 31% có findings, trung bình 0,5 issues |

| Min version | Claude Code v2.1.86+ |

| Auth | Claude.ai login (API key alone không chạy được) |

| Token estimate | ~3M tokens/review (ước tính từ giá $15–25 ở mức Opus) |

So sánh /review vs /ultrareview vs các tool khác

| /review (local) | /ultrareview (cloud) | |

|---|---|---|

| Where | Local terminal session | Remote cloud sandbox |

| Depth | Single-pass | Multi-agent fleet + independent verification |

| Duration | Vài giây – vài phút | 5–10 phút |

| Cost | Tính vào normal usage | $5–$20/run extra usage |

| Best for | Inner-loop iteration | Pre-merge gate cho substantial changes |

vs Claude Code GitHub Action: Action vẫn open source, nhẹ và rẻ hơn. /ultrareview là phiên bản "more thorough (and more expensive)".

vs Claude Code Security: Khác sản phẩm. Security là continuous deep security scan toàn codebase. /ultrareview tập trung logic bug per-PR (có flag security issue nhưng không sâu bằng).

vs GitHub Copilot review & CodeRabbit: Anthropic đánh vào kiến trúc multi-agent + tốc độ chậm-mà-sâu, đổi speed lấy thoroughness và false-positive thấp.

Use cases

/ultrareview xứng đáng tiền cho các pre-merge change "đắt giá nếu miss bug":

- Refactor động tới auth flow

- Data migration quy mô lớn

- Code đụng tới concurrency

- Long-running feature branch

- Các change cross-file (agent có thể duyệt cả codebase, không chỉ diff)

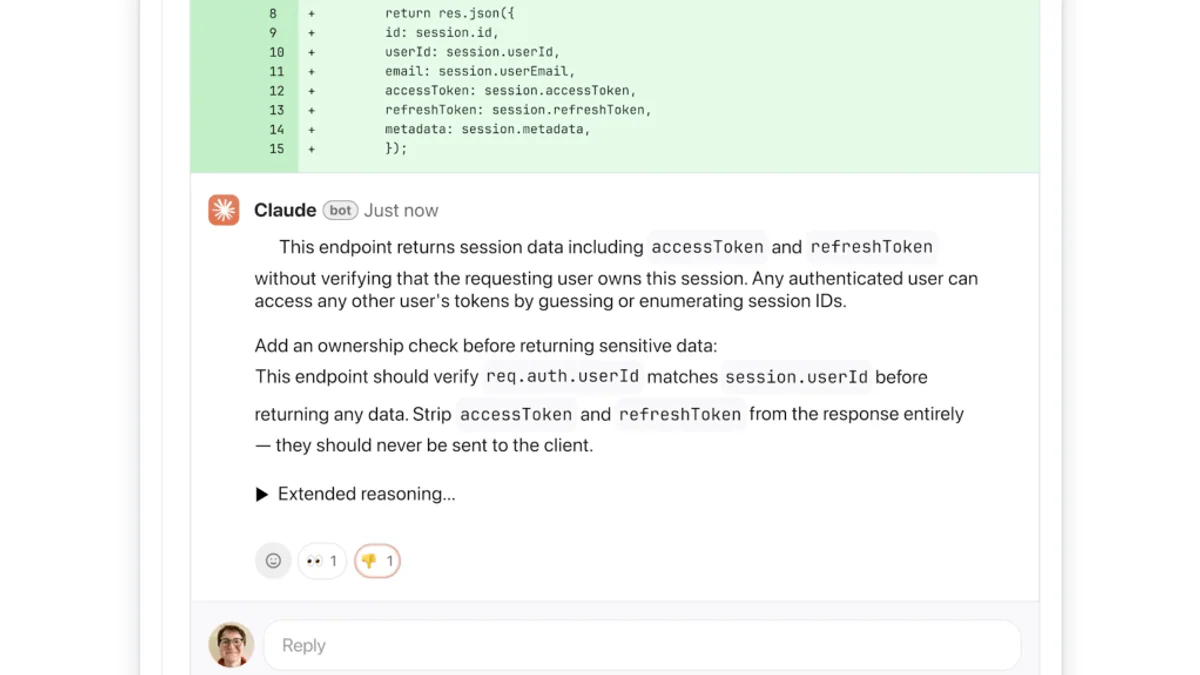

Cat Wu giải thích lý do tool chỉ tập trung logic bug, bỏ qua style: "Khi review AI-generated, người ta chỉ muốn logic error. Nếu chỉ focus vào real bug, false positive rate thấp tự nhiên — vì khi đã biết là bug thì gần như chắc chắn phải fix."

Cho diff nhỏ, sanity check nhanh: /review local vẫn nhanh hơn, rẻ hơn, đủ dùng. Để dành multi-agent fleet cho lúc miss bug sẽ trả giá đắt.

Limitations & pricing

Hạn chế:

- Research preview — feature, pricing, availability có thể đổi

- Không chạy trên Bedrock, Vertex AI, Microsoft Foundry, hoặc org có Zero Data Retention

- Bắt buộc Claude.ai login (không chấp nhận API-key-only session)

- Phải bật "extra usage" trước khi chạy paid run

- Repo quá lớn → bắt buộc switch sang PR mode (push branch, tạo draft PR)

- Một số user trên v2.1.111 báo command không hiện — feature flag + entitlement gating server-side

- Critique từ cộng đồng: "Claude viết code rồi Claude review code — closed-loop có an toàn không?"

Pricing:

| Plan | Free runs | After |

|---|---|---|

| Pro | 3 runs (one-time, hết hạn 5/5/2026) | $5–$20/run extra usage |

| Max | 3 runs (one-time, hết hạn 5/5/2026) | $5–$20/run extra usage |

| Team / Enterprise | 0 | Billed ngay (avg $15–25/PR) |

Admin có monthly cap, per-repo enable, analytics dashboard tracking PR reviewed + acceptance rate + cost.

What's next

Anthropic đã dogfood Code Review nội bộ vài tháng trước khi ra mắt 9/3/2026. Phiên bản CLI /ultrareview mở cho Pro/Max ở dạng research preview trong tháng 4. Free run cho Pro/Max hết hạn 5/5/2026 — sau đó tất cả là extra usage.

Theo Cat Wu, nếu có nhu cầu, Anthropic có thể mở Code Review cho các tier khác. Tool tồn tại song song với Claude Code GitHub Action (open source, nhẹ) và Claude Code Security (deep security scan).

Nguồn: Anthropic Blog, Claude Code Docs, The New Stack, TechCrunch, InfoQ.