- MZLA Technologies (công ty con của Mozilla, đứng sau Thunderbird) vừa công bố Thunderbolt: một AI client mã nguồn mở MPL-2.0 cho doanh nghiệp, tự host bằng Docker hoặc Kubernetes, tự chọn model (Anthropic, OpenAI, Mistral, Ollama, llama.cpp), và giữ toàn bộ dữ liệu trong vành đai công ty.

TL;DR

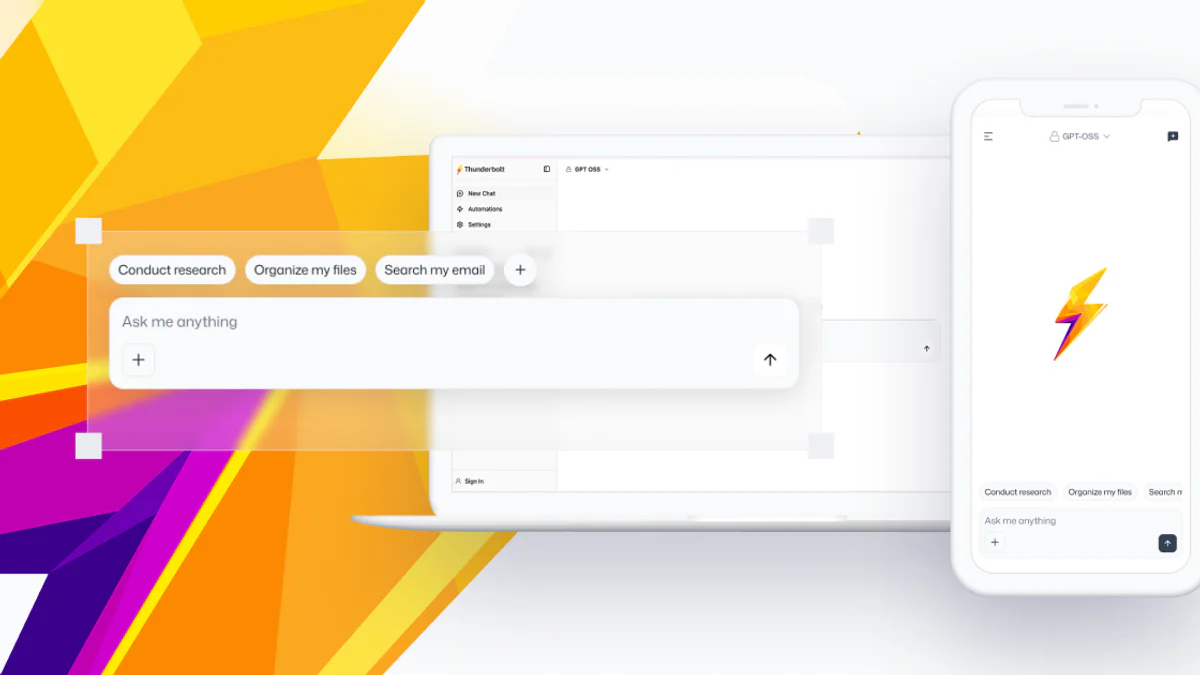

Thunderbolt là AI client mã nguồn mở (MPL-2.0) do MZLA Technologies — công ty con vì lợi nhuận của Mozilla Foundation, đơn vị đứng sau email client Thunderbird — công bố ngày 16/04/2026. Slogan: "AI You Control: Choose your models. Own your data. Eliminate vendor lock-in."

- Self-host bằng Docker Compose hoặc Kubernetes, có thể chạy gọn trên 1 máy.

- Hỗ trợ frontier models (Anthropic, OpenAI, Mistral), local inference (Ollama, llama.cpp), và bất kỳ provider OpenAI-compatible nào.

- Tích hợp deepset Haystack, MCP (preview), ACP (đang phát triển — target tháng 4/2026).

- Có app native cho Windows, macOS, Linux, iOS, Android + web client.

- Đang trong active development và security audit — chưa production-ready, nhưng code đã trên GitHub, doanh nghiệp join waitlist tại thunderbolt.io.

Có gì mới

Mozilla không lạ gì AI — họ từng đầu tư mạnh vào Mozilla.ai và open-source LLM. Thunderbolt khác ở chỗ: đây là sản phẩm enterprise đầu tiên của MZLA nhắm thẳng vào thị phần ChatGPT Enterprise, Microsoft Copilot và Claude Enterprise.

Sản phẩm tự định vị là "sovereign AI client" — workspace AI thống nhất với 3 chế độ: Chat, Search, và research. Admin chọn model nào sẽ chạy phía sau giao diện, chọn data source nào được kết nối, và quan trọng nhất: tất cả luồng dữ liệu nằm gọn trong hạ tầng của tổ chức, không đi qua server bên thứ ba.

CEO MZLA Ryan Sipes nói thẳng với The Register: "Vấn đề chúng tôi giải quyết là chủ quyền và quyền kiểm soát. Bạn có thực sự muốn xây workflow AI của mình trên service độc quyền của OpenAI hay Anthropic — và để toàn bộ dữ liệu nội bộ chảy qua hệ thống của họ?"

Vì sao đáng quan tâm

Sipes ví bối cảnh hiện tại với thời Internet Explorer thống trị 95% thị phần trước khi Firefox xuất hiện: "Chúng ta — không chỉ Mozilla — phải tạo ra giải pháp thay thế cho Copilot và ChatGPT, để tương lai của AI không phải là chúng ta đi thuê nó từ vài công ty khổng lồ."

Với các tổ chức ở ngành chịu kiểm soát chặt — y tế, tài chính, luật, chính phủ — đây không chỉ là chuyện ý thức hệ. Data residency, GDPR, HIPAA, các yêu cầu compliance nội bộ đều khiến việc gửi prompt chứa dữ liệu khách hàng qua API của OpenAI/Anthropic trở thành rào cản pháp lý thực sự. Thunderbolt cho họ một con đường: chạy frontier model qua API key của mình, hoặc chạy hẳn local model bằng Ollama, mà vẫn dùng chung một workspace UI và tooling.

Sự thật kỹ thuật

| Khoản mục | Chi tiết |

|---|---|

| License | Mozilla Public License 2.0 (MPL-2.0) |

| Codebase | TypeScript 96.6% + CSS, Astro, Rust, Shell |

| Repo activity | ~4k stars, 249 forks, 11 contributors lúc ra mắt |

| Platforms | Web + native: Windows, macOS, Linux, iOS, Android |

| Frontier models | Anthropic, OpenAI, Mistral (qua API key của bạn) |

| Local inference | Ollama, llama.cpp |

| Custom providers | Bất kỳ endpoint OpenAI-compatible nào |

| Deployment | Docker Compose hoặc Kubernetes |

| Integrations | deepset Haystack, MCP (preview), ACP (active dev) |

| Workspace modes | Chat + Search |

| Security | Self-hosted, optional E2E encryption, device-level access |

| Telemetry | PostHog, ON mặc định, có thể tắt |

So sánh với đối thủ

| Tiêu chí | Thunderbolt | ChatGPT Enterprise / Claude Enterprise / Copilot |

|---|---|---|

| Hosting | Tự host trên hạ tầng khách hàng | Vendor cloud |

| Model | Pick any: frontier, local, hoặc OpenAI-compatible | Khoá vào stack của vendor |

| Đường đi của data | Trong vành đai công ty | Qua server vendor |

| License | MPL-2.0 mã nguồn mở | Độc quyền |

| Integration | Haystack + MCP + ACP, pluggable | Connector vendor định nghĩa |

| Cost | Free deploy; trả phí enterprise support | Per-seat subscription |

Trong không gian mã nguồn mở, Thunderbolt đứng cạnh Open WebUI và LibreChat — những self-hosted AI frontend đã có vài năm. Khác biệt chính: Thunderbolt có enterprise-grade integration (Haystack + MCP + ACP) và đi kèm field deployment engineers (FDE) khi mua enterprise license — yếu tố quan trọng để vào ngành ngân hàng hoặc y tế lớn.

Use cases thực tế

MZLA target rõ: doanh nghiệp có yêu cầu data residency / compliance khắt khe — y tế, luật, tài chính, chính phủ. Workflow điển hình:

- Daily briefing tự động: agent chạy theo lịch, tổng hợp tin nội bộ + tin ngành, gửi tới các trưởng phòng buổi sáng.

- Topic monitoring: theo dõi từ khoá / chủ đề trong knowledge base nội bộ và alert khi có thay đổi.

- Report compilation: kéo dữ liệu từ nhiều hệ thống nội bộ qua Haystack, dựng báo cáo định kỳ.

- Event-triggered actions: khi điều kiện xảy ra (case mới, ticket vượt SLA, anomaly), agent tự kích hoạt action.

- Air-gapped chat: chạy hoàn toàn local trên 1 máy với Ollama cho dữ liệu cực nhạy.

Nhân viên dùng cùng workspace từ desktop hay mobile — môi trường AI không đổi giữa các thiết bị, mà data vẫn không rời tổ chức.

Hạn chế & giá

- Còn sớm: vẫn đang active development, đang trong giai đoạn security audit, chưa được tuyên bố production-ready cho enterprise.

- Chưa fully offline-first: hiện vẫn cần authentication và search (search có thể tắt trong settings).

- Chưa có public inference endpoint: bạn phải tự cắm API key hoặc dựng Ollama / llama.cpp.

- MCP đang preview, ACP đang dev với target tháng 4/2026.

- Telemetry ON mặc định qua PostHog (chat activity, model selection, settings, location). Tắt được, không thu PII nếu không có consent.

- Pricing: code free dưới MPL-2.0. Doanh thu của MZLA đến từ enterprise license + professional support + FDE + bản hosted có quản lý sẽ ra sau.

- Availability: code đã trên GitHub. Doanh nghiệp quan tâm join waitlist tại thunderbolt.io.

Điều gì sắp tới

Roadmap gần của MZLA gồm: hoàn thành security audit để đạt enterprise production readiness; ship offline-first thực sự; mở public inference endpoint cho khách không muốn tự lo model; release bản managed hosted cho team nhỏ và enterprise không muốn ôm hạ tầng; và một bản dành cho người dùng cá nhân (chưa có ngày phát hành).

Nếu bạn là kỹ sư hạ tầng đang đánh giá self-hosted AI cho công ty: clone repo, dựng Docker stack thử trong môi trường staging, cắm Ollama với gpt-oss hoặc llama-3.3 để đo end-to-end latency và chất lượng output trước khi quyết định.

Nguồn: GitHub repo, The Register, Phoronix, It's FOSS, OMG! Ubuntu, gHacks.