- Nhóm HKU & Sreal AI công bố MultiWorld — framework open-source sinh video có thể điều khiển nhiều agent cùng lúc, nhất quán qua nhiều camera.

- Dataset 21M+ frame, đã có checkpoint + code ngày 21/4/2026.

TL;DR

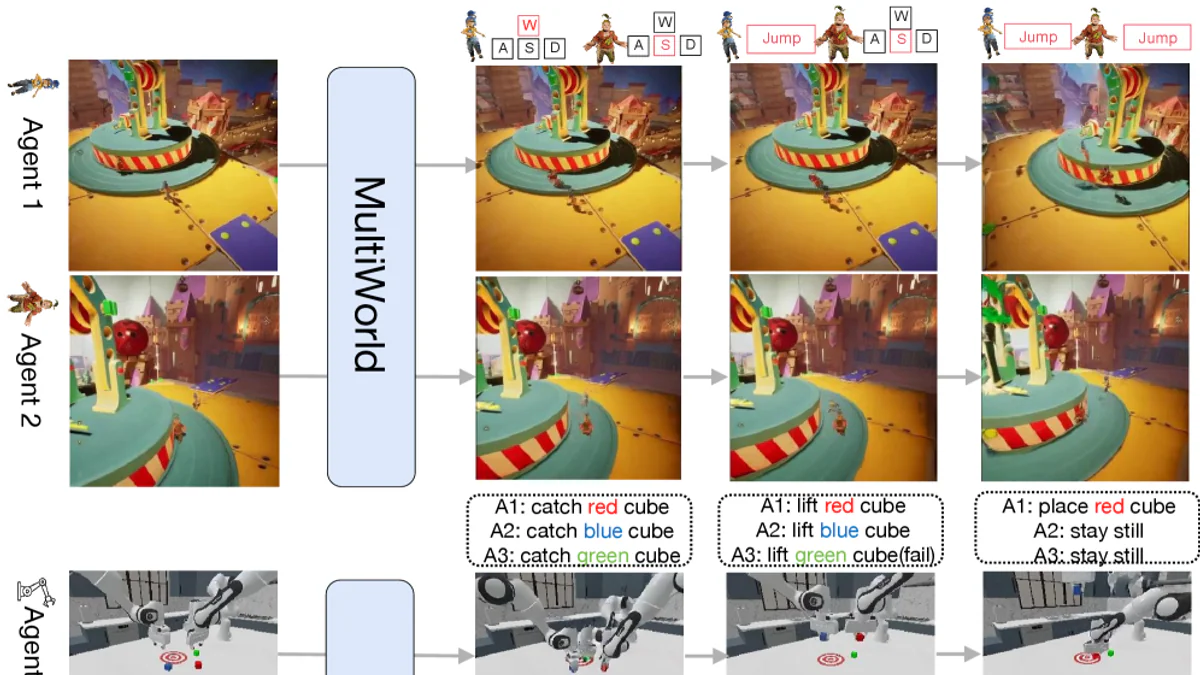

MultiWorld là video world model đầu tiên mở rộng được sang kịch bản multi-agent + multi-view. Do nhóm HKU & Sreal AI công bố ngày 20/4/2026, framework này sinh video có thể điều khiển chính xác hành động của nhiều agent cùng lúc, đồng thời giữ nhất quán quan sát qua nhiều góc camera. Toàn bộ code, checkpoint và dataset (hơn 21 triệu frame) đã open-source.

What's new

Các video world model đang nổi như Genie, GameNGen, DIAMOND, Oasis đều giới hạn ở một agent. MultiWorld là lần đầu có một framework thống nhất giải quyết cả hai bài toán khó:

- Multi-agent controllability — điều khiển chính xác hành động của từng agent riêng biệt trong cùng một cảnh.

- Multi-view consistency — đảm bảo các góc camera quan sát cùng một thế giới nhất quán, không "lệch pha".

Paper xuất hiện trên arXiv ngày 20/4/2026 (v1) và cập nhật v2 ngày 21/4. Repo GitHub đã đạt 117 sao chỉ sau vài ngày mở public.

Why it matters

Thế giới thực vốn là multi-agent — game co-op 2-4 người chơi, đội robot phối hợp gắp vật, xe tự lái chia sẻ giao lộ. Nhưng world model trước đây chỉ học được hành vi của một tác nhân, nên không thể làm simulator cho huấn luyện policy đa phía hoặc test kịch bản tương tác. MultiWorld mở đường cho:

- Sinh synthetic data có label action cho training agent đa phía.

- Làm neural game engine cho game nhiều người chơi mà không cần engine vật lý truyền thống.

- Rút ngắn vòng lặp sim-to-real cho robotics cộng tác.

Technical facts

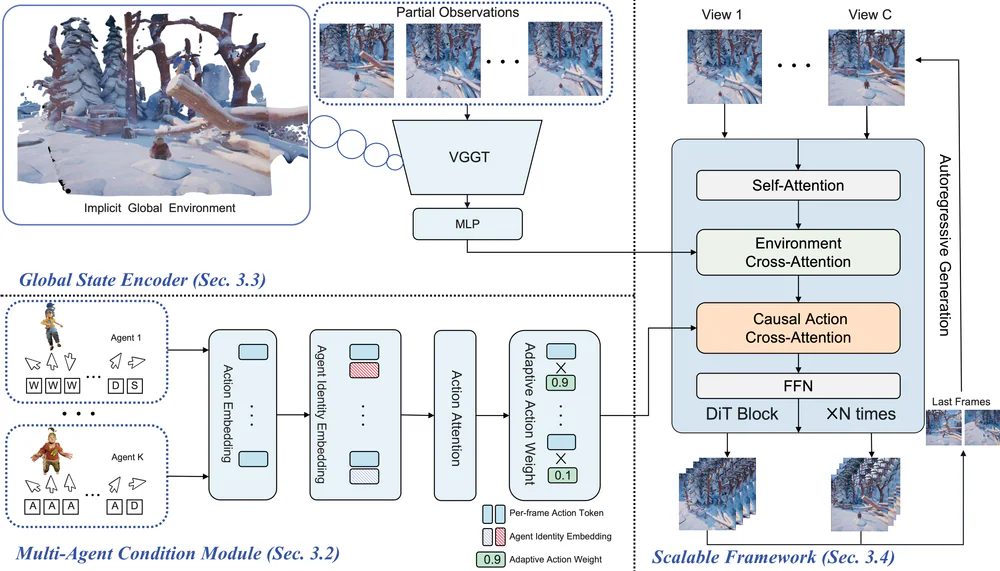

MultiWorld kết hợp 3 thành phần chính:

- Multi-Agent Condition Module (MACM): dùng Agent Identity Embedding (Rotary Position Embedding) + Adaptive Action Weighting để ưu tiên động các agent đang hoạt động, giảm nhiễu từ agent tĩnh.

- Global State Encoder (GSE): backbone

VGGTfrozen trích xuất feature 3D-aware từ quan sát từng view, nén thành global representation qua cross-attention. - Parallel view synthesis: sinh các view song song → nhanh hơn baseline 1.5×. Autoregressive inference cho phép generate dài hơn training context.

Kết quả benchmark (càng cao càng tốt với SSIM/PSNR/Accuracy; càng thấp càng tốt với FVD/LPIPS/RPE):

| Metric | It Takes Two (game, 480p) | RoboFactory (robot, 320p) |

|---|---|---|

| FVD ↓ | 179 | 96 |

| LPIPS ↓ | 0.35 | 0.07 |

| SSIM ↑ | 0.51 | 0.90 |

| PSNR ↑ | 17.72 | 26.60 |

| Action Accuracy ↑ | 89.8% | 88.7% |

| RPE ↓ | 0.67 | 1.52 |

Comparison

So với các world model single-agent trước đó:

- Genie / GameNGen / DIAMOND / Oasis: chỉ 1 agent điều khiển, 1 view — không thể mô phỏng co-op hoặc multi-robot.

- MultiWorld: linh hoạt thay đổi số agent và số camera mà không cần retrain từ đầu. Đồng thời outperform baselines trên cả 3 nhóm metric — video fidelity, action-following, multi-view consistency — ở cả domain game và robotics.

Use cases

- Game AI research: mô phỏng game co-op như It Takes Two để train NPC hoặc test gameplay logic.

- Multi-robot collaboration: simulator cho 2-4 tay máy phối hợp — hỗ trợ RoboFactory task (catch, lift, place cube).

- Embodied AI: nền tảng nghiên cứu tương tác đa tác nhân, predict future frames từ action input.

- Synthetic data generation: sinh video có label action để train downstream model ở quy mô lớn.

Limitations & pricing

- Miễn phí hoàn toàn: code, checkpoint (480p + 320p), dataset trên HuggingFace/ModelScope.

- Yêu cầu hardware nặng: inference phân tán khuyến nghị 8 GPU; training cần multi-GPU scale lớn hơn.

- Resolution còn khiêm tốn: game 480×960, robot 256×320 — chưa lên 1080p/4K.

- Domain hẹp: hiện benchmark trên 1 game (It Takes Two) và 4 task RoboFactory với 2-4 agent. Chưa mở rộng ra open-world game hoặc real-world robotics.

What's next

Repo đang active — 117 sao trong ~3 ngày kể từ khi công bố. Các hướng phát triển tự nhiên: nâng resolution từ 480p lên 1080p, giảm yêu cầu 8 GPU xuống mức consumer, tích hợp với RL policy training để đóng vòng lặp sim-and-train, và thử nghiệm trên open-ended game hoặc real-robot data thay vì chỉ simulation. Với toàn bộ weight + data mở công khai trên HuggingFace và ModelScope, cộng đồng có thể fork nhanh cho domain riêng — từ autonomous driving đa xe đến drone swarm, đến game co-op bất kỳ. Đây cũng là tín hiệu thú vị cho thấy world model đang thoát khỏi bài toán single-agent để bước vào thế giới thật — nơi mọi thứ đều là tương tác giữa nhiều tác nhân.

Nguồn: arXiv 2604.18564, Project page, GitHub repo, HuggingFace paper.