- Nhóm nghiên cứu từ NUDT, Zhejiang và Westlake vừa công bố PiLoT tại CVPR 2026 — hệ AI ghép trực tiếp video drone vào bản đồ 3D, đạt 25+ FPS real-time và 100% success rate xuyên ngày/đêm, không cần GPS hay IMU.

TL;DR

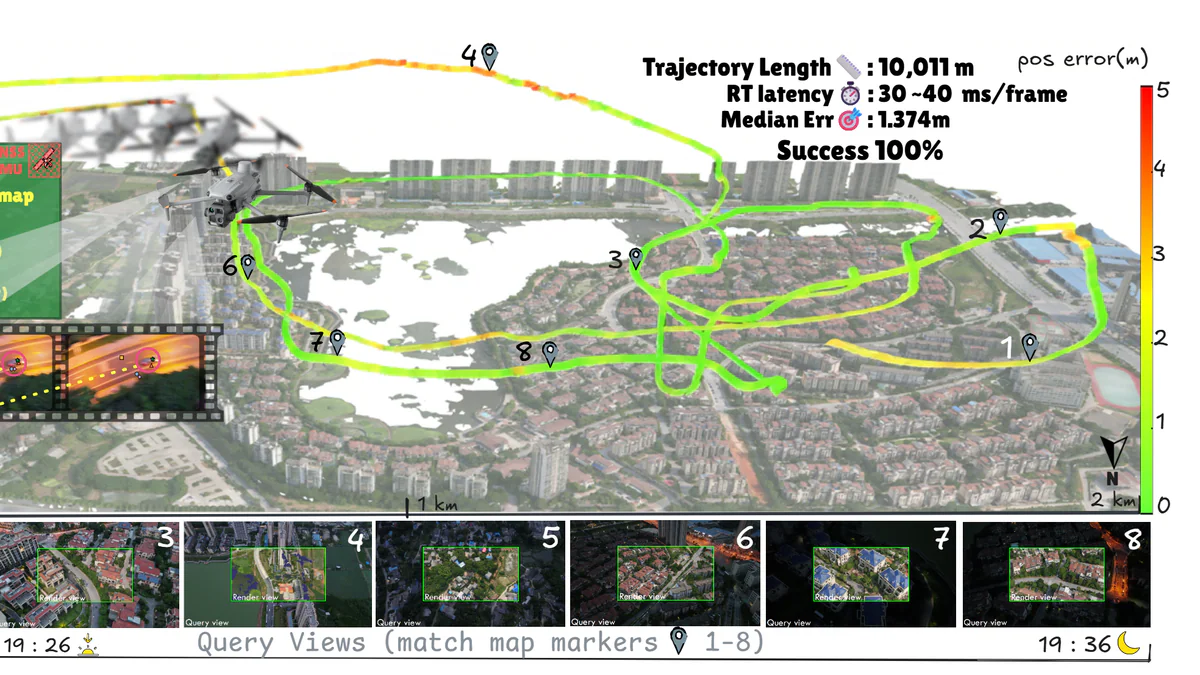

PiLoT (Pixel-to-3D Localization and Target geo-localization) là hệ thống AI mới từ National University of Defense Technology, Zhejiang University, Westlake University và Hangzhou Dianzi University — vừa được CVPR 2026 chấp nhận. Nó cho phép drone tự định vị và chỉ điểm toạ độ mục tiêu trên mặt đất chỉ bằng một camera, bằng cách ghép trực tiếp video live vào bản đồ 3D đã dựng sẵn. Không GPS, không IMU, không VIO. Sai số trung vị 1.37 m trên quỹ đạo 10 km, chạy 25+ FPS trên Jetson Orin, và 100% success rate xuyên ngày/đêm lẫn đổi mùa.

Điều gì mới

Trước PiLoT, drone mất GPS là gần như mất phương hướng. Các hệ thống GNSS-VIO (kết hợp vệ tinh + cảm biến quán tính) drift dần theo thời gian và sập hẳn trong môi trường GPS-denied: hẻm đô thị, vùng bị jam, trong nhà, hoặc chiến trường. Những phương pháp image-retrieval dùng ảnh vệ tinh 2D lại brittle với đổi mùa, đổi ánh sáng và chỉ hoạt động ở góc top-down.

PiLoT bẻ gãy paradigm đó. Thay vì ghép 2D-với-2D, nó ghép pixel live của camera trực tiếp với mô hình 3D của khu vực (dựng bằng 3D Gaussian Splatting). Đầu ra: 6-DoF pose của drone và toạ độ địa lý 3D cho bất kỳ pixel nào operator click trên màn hình.

Cách hoạt động

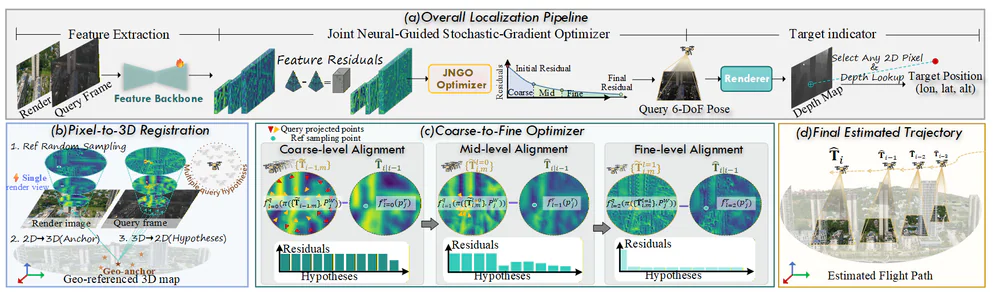

Hệ thống chạy kiến trúc dual-thread, tách rời render bản đồ khỏi localization:

- Render Thread — dựng on-the-fly một "synthetic view" geo-referenced từ bản đồ 3D theo góc nhìn hiện tại của drone.

- Localization Thread — chạy song song, match video live vào synthetic view trong feature space, đảm bảo mỗi frame được neo vào geo-anchor được update liên tục.

Bộ não tối ưu hoá là Joint Neural-Guided Stochastic-Gradient Optimizer (JNGO) — coarse-to-fine, thu nhỏ dần không gian tìm kiếm để hội tụ 6-DoF pose ngay cả khi drone chuyển động mạnh. Thêm one-to-many paradigm: nhiều hypotheses query được match đồng thời vào một rendered view, cho robust khi appearance thay đổi theo thời tiết/mùa.

Con số kỹ thuật

| Chỉ số | Giá trị |

|---|---|

| Median error | 1.37 m |

| Per-frame latency | 30–40 ms |

| Frame rate | 25+ FPS trên NVIDIA Jetson Orin |

| Quỹ đạo test | 10 km |

| Success rate | 100% xuyên day/night + cross-season |

| Training data | Million-scale synthetic flights |

| Transfer | Zero-shot sim-to-real |

Toàn bộ mô hình train chỉ bằng data tổng hợp (bay mô phỏng trên địa hình photorealistic toàn cầu, kèm RGB + depth + camera pose + đa dạng thời tiết/ánh sáng) nhưng deploy trực tiếp lên video drone thật mà không cần fine-tune.

So với các phương pháp hiện tại

| Phương pháp | Cần sensor | Vấn đề |

|---|---|---|

| GNSS-VIO (GVINS, ORB-SLAM3) | GPS + IMU + camera | Drift tích luỹ, sập khi GPS denied |

| Satellite cross-view matching | Camera + ảnh vệ tinh 2D | Brittle với mùa/ánh sáng, chỉ top-down |

| VIO / SLAM không GNSS | Camera + IMU | Không có toạ độ địa lý tuyệt đối |

| PiLoT | Chỉ 1 camera | Cần bản đồ 3D dựng sẵn |

PiLoT là phương pháp đầu tiên đồng thời giải ego localization (drone ở đâu) và target geo-localization (mục tiêu ở đâu) trong một pass duy nhất, drift-free trên quỹ đạo dài.

Ứng dụng

- UAV trong môi trường GPS-denied — hẻm đô thị, khu vực bị jam, vùng chiến sự.

- Search & rescue — operator click vào người hoặc vật thể trong live feed, hệ thống trả về toạ độ chính xác cho đội mặt đất.

- Giám sát & reconnaissance — định vị mục tiêu không cần laser rangefinder (không lộ vị trí).

- Precision agriculture / infrastructure inspection — tìm cây bệnh hoặc lỗi hạ tầng cụ thể trên bản đồ 3D.

- Disaster response — cơ sở hạ tầng GPS bị hỏng vẫn có thể phối hợp cứu hộ.

Hạn chế & pricing

- Cần bản đồ 3D dựng trước (3D Gaussian Splatting). Không chạy được ở vùng chưa map.

- Cần GPU — tối thiểu Jetson Orin. Chưa có bản CPU-only / low-power.

- Code chưa đầy đủ — tháng 4/2026 mới release inference + checkpoint + demo scene (Jadebay) trên GitHub; training code và scene lớn hơn "coming soon".

- Academic research code, MIT license. Muốn tích hợp vào drone commercial cần effort engineering.

- Open-source miễn phí — weights + demo data qua Google Drive và Hugging Face.

Chặng tiếp theo

Paper submit arXiv ngày 21/3/2026, revision cuối 27/3/2026, trình bày chính thức tại CVPR 2026 giữa năm. Roadmap: full training code, test scene lớn hơn, dataset mở rộng. Với việc toàn bộ stack là camera-only + synthetic-trained, PiLoT mở đường cho một thế hệ drone autonomous không phụ thuộc vệ tinh — đặc biệt có ý nghĩa cho defense, logistics last-mile, và disaster response trong vùng GPS bị compromise.

Nguồn: Project page, arXiv 2603.20778, GitHub Choyaa/PiLoT.