- NVIDIA mở Early Access GR00T N1.7 — VLA model 3B tham số, pre-train trên 20,854 giờ video egocentric người thật, tìm ra scaling law đầu tiên cho robot dexterity.

- Code Apache 2.0, weights thương mại.

TL;DR

NVIDIA vừa mở Early Access cho Isaac GR00T N1.7 — Vision-Language-Action (VLA) foundation model 3B tham số, cấp phép thương mại, dành cho humanoid robot. Điểm đột phá: pre-train trên 20,854 giờ video egocentric người thật (dataset EgoScale) và phát hiện scaling law đầu tiên cho robot dexterity — tăng data từ 1k lên 20k giờ thì gấp đôi tỉ lệ hoàn thành task. Code Apache 2.0, weights NVIDIA Open Model License, có sẵn trên Hugging Face + GitHub.

Có gì mới

GR00T N1.7 là bản cập nhật lớn so với N1.6, không chỉ patch nhỏ:

- VLM backbone mới —

Cosmos-Reason2-2B(Qwen3-VL) thay cho Eagle, tăng khả năng reasoning đa bước và hiểu ngôn ngữ tự nhiên. - EgoScale pre-training — 20,854 giờ video egocentric người thật, trải 20+ task category (sản xuất, bán lẻ, y tế, gia đình) — nhảy vọt từ vài nghìn giờ teleoperation robot của N1.6.

- Drop-in swap — embodiment config và workflow cũ vẫn chạy, không phải viết lại pipeline.

- Full export sang ONNX và TensorRT ngay từ repo chính thức.

- Pipeline xử lý data đơn giản hơn, giảm friction cho team fine-tune nội bộ.

Vì sao quan trọng

Đây là lần đầu tiên có bằng chứng scaling law cho robot dexterity tương tự scaling law LLM: cho thêm data (đặc biệt là video người thao tác) thì năng lực dexterous manipulation cải thiện đều đặn, dự đoán được. Với LLM, phát hiện này kéo theo cả làn sóng foundation model. Với robot, nếu scaling law đúng rộng hơn, công thức mới là "cứ thu thêm video egocentric người thật là robot sẽ khéo tay hơn" — rẻ hơn teleoperation nhiều lần.

Ngoài ra, license thương mại mở giúp startup robot và nhà máy dùng thẳng trong sản phẩm thật mà không phải đàm phán license riêng như các đối thủ VLA khác.

Chi tiết kỹ thuật

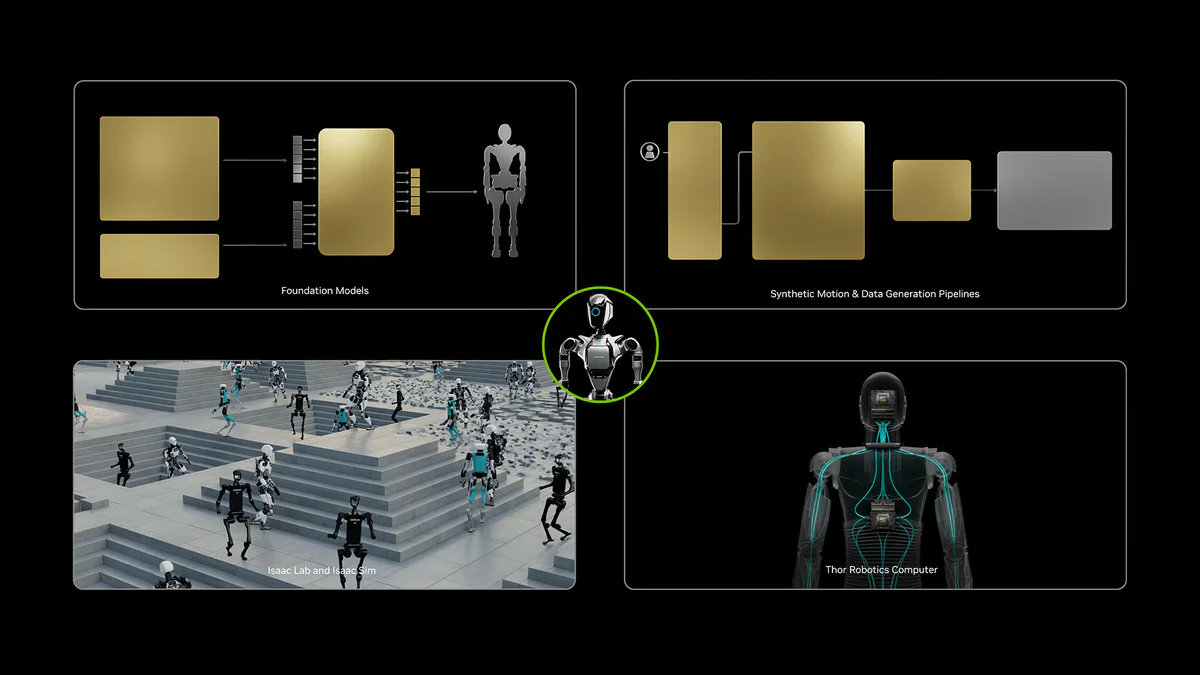

Kiến trúc Action Cascade hai tầng (dual-system):

- System 2 (chậm, lý luận): Cosmos-Reason2-2B VLM — nhận RGB frame + câu lệnh ngôn ngữ, sinh high-level action token và phân rã task.

- System 1 (nhanh, điều khiển): Diffusion Transformer 32 layer — nhận action token từ System 2 + robot state (joint position/velocity, EEF pose), denoise ra motor command liên tục theo thời gian thực.

| Property | GR00T N1.7 |

|---|---|

| Total params | 3B |

| VLM backbone | Cosmos-Reason2-2B (Qwen3-VL) |

| Action head | 32-layer Diffusion Transformer |

| Denoising steps | 4 |

| Inference GPU | 16GB+ VRAM (RTX 4090 / L40 / H100 / Jetson AGX Thor / DGX Spark) |

| Fine-tune GPU | 40GB+ VRAM (H100/L40 khuyến nghị) |

| Pre-training data | 20,854 giờ video egocentric (EgoScale) |

| Code license | Apache 2.0 |

| Weights license | NVIDIA Open Model License (thương mại) |

So với N1.6

| Aspect | N1.6 | N1.7 |

|---|---|---|

| VLM backbone | Eagle | Cosmos-Reason2-2B / Qwen3-VL |

| Pre-training | Vài nghìn giờ teleoperation | 20,854 giờ EgoScale human video |

| Scaling law | Chưa chứng minh | 1k → 20k giờ → 2× task completion |

| Export | Hạn chế | ONNX + TensorRT đầy đủ |

| Config cũ | — | Drop-in swap, không phải viết lại |

Use case và robot hỗ trợ

GR00T N1.7 nhắm thẳng sàn nhà máy và môi trường thật:

- Material handling — di chuyển, sắp xếp linh kiện.

- Packaging & inspection — đóng gói, kiểm tra QC.

- Loco-manipulation — robot vừa di chuyển vừa thao tác.

- Dexterous bimanual — hai tay phối hợp, bàn tay 22 DoF xử lý chi tiết nhỏ (lắp ráp, thao tác contact-rich).

Robot validated: Unitree G1, AGIBot Genie 1, Bimanual Manipulator YAM, Franka Panda (LIBERO benchmark), WidowX, Google Robot (SimplerEnv), DROID, SO100 arm. Pre-register embodiments: UNITREE_G1, LIBERO_PANDA, OXE_WIDOWX, và cho phép register embodiment tuỳ biến.

Giới hạn & giá

- Early Access — API và checkpoint có thể thay đổi trước bản GA.

- Chưa có bảng benchmark so sánh công khai với OpenVLA, RT-2, hay π0 trong bài blog — phải tự reproduce.

- Bản chính thức HF/GitHub không kèm pricing — weights + code miễn phí, kể cả deploy production.

- Gate phần cứng: tối thiểu GPU 16GB VRAM cho inference. Fine-tune thực tế cần 40GB+, lý tưởng là node H100/L40.

- Platform driver: CUDA 12.8 / Python 3.10 cho dGPU, CUDA 13.0 / Python 3.12 cho Jetson Thor & DGX Spark.

Tiếp theo

NVIDIA kêu gọi cộng đồng fine-tune và feedback từ deployment thật. GR00T N là series model nên N1.8/N2 gần như chắc chắn sẽ tới, có thể mở rộng EgoScale lên 50k–100k giờ nếu scaling law giữ vững. Với mô hình 3B chạy được trên Jetson AGX Thor, kịch bản thú vị là fleet humanoid edge-inference triển khai diện rộng mà không cần cloud round-trip.

Thử ngay: HF blog, model weights, GitHub repo.

Nguồn: Hugging Face, NVIDIA GitHub, NVIDIA Developer.