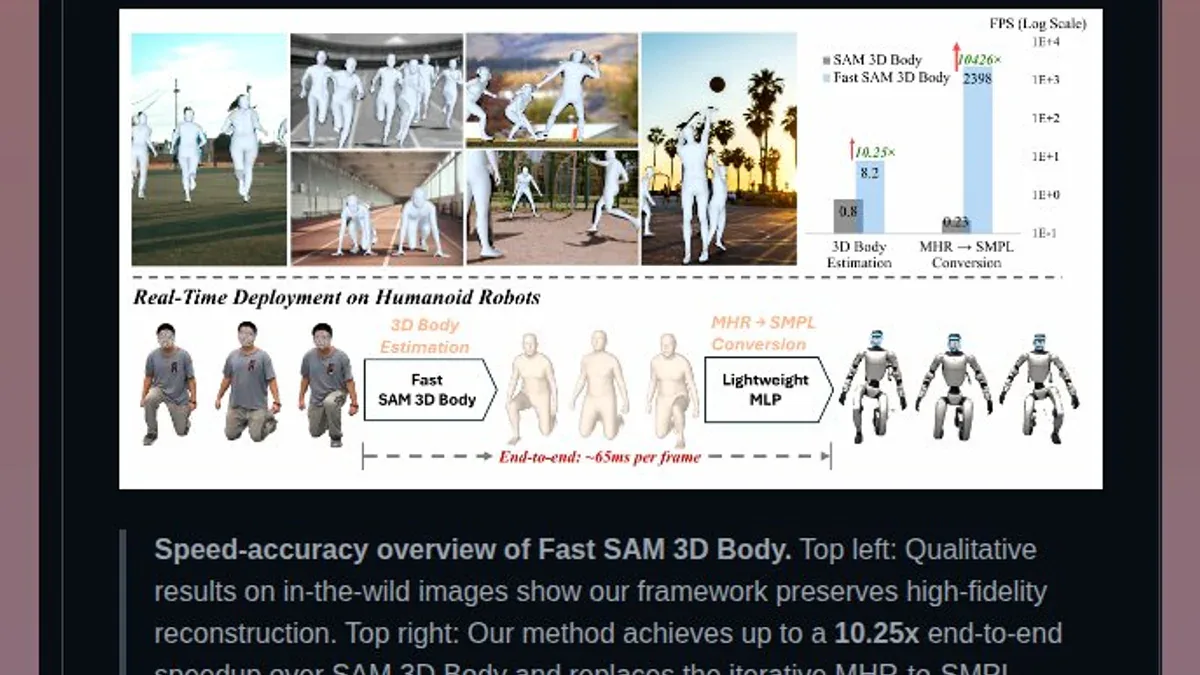

- Fast SAM 3D Body đạt tốc độ 10.25x so với SAM 3D Body gốc của Meta, riêng bước SMPL conversion nhanh hơn 10,000x.

- Latency ~65ms/frame trên RTX 5090, đủ điều khiển robot humanoid Unitree G1 theo thời gian thực.

- MIT license, training-free, mã nguồn mở hoàn toàn.

TL;DR

Fast SAM 3D Body là framework tăng tốc training-free cho SAM 3D Body của Meta AI - giúp phục hồi 3D human mesh toàn thân từ ảnh RGB đơn lẻ theo thời gian thực. So với phiên bản gốc: nhanh hơn 10.25x end-to-end, riêng bước chuyển đổi SMPL nhanh hơn 10,000x. Latency ~65ms/frame trên RTX 5090. MIT license, mã nguồn mở hoàn toàn.

Tại sao cần real-time human mesh recovery?

Khôi phục tư thế 3D toàn thân người (full-body human mesh recovery) từ camera RGB đơn - không cần suit cảm biến, không cần nhiều góc nhìn - là bài toán cốt lõi của nhiều ứng dụng: điều khiển robot humanoid, thu thập dữ liệu imitation learning, motion capture, và augmented reality.

SAM 3D Body của Meta AI (ra mắt tháng 2/2026) đã giải quyết bài toán này với chất lượng state-of-the-art, nhưng tốc độ suy diễn chưa đủ cho real-time. Pipeline gốc dùng iterative mesh fitting - lặp đi lặp lại để căn chỉnh SMPL mesh - tốn hàng trăm millisecond mỗi frame. Với ứng dụng robot cần phản ứng dưới 100ms, đây là nút thắt cổ chai cứng không thể bỏ qua.

Fast SAM 3D Body (arXiv:2603.15603, nộp 16/3/2026) từ nhóm USC Physical Superintelligence Lab, UCSD, NVIDIA, và Meta Reality Labs ra đời để phá vỡ giới hạn đó - mà không cần huấn luyện lại bất kỳ thứ gì.

Kỹ thuật bên trong

Thay vì xây model mới, nhóm tác giả phân tích từng bottleneck của pipeline SAM 3D Body và áp dụng 4 chiến lược tối ưu đồng thời:

- Decouple serial spatial dependencies: pipeline gốc buộc phải xử lý các image crop tuần tự vì phụ thuộc lẫn nhau về mặt không gian. Fast SAM 3D Body tách bỏ dependency này, cho phép song song hóa hoàn toàn.

- Architecture-aware pruning: cắt bỏ các nhánh không cần thiết trong transformer decoder dựa trên phân tích đóng góp thực sự của từng component.

- Parallelized multi-crop feature extraction: trích đặc trưng từ nhiều vùng ảnh cùng một lúc, thay vì tuần tự từng crop.

- Direct feedforward SMPL mapping: thay thế hoàn toàn vòng lặp iterative fitting bằng một lightweight MLP - feedforward một lần là ra kết quả, không lặp lại.

Chính bước cuối này tạo ra con số ấn tượng nhất: 10,000x tăng tốc riêng cho bước MHR-to-SMPL conversion. Toàn bộ backbone pipeline: DINOv3 (feature extraction, auto-download từ HuggingFace) + yolo11m-pose YOLO-Pose (phát hiện người) + MoGe với DINOv2 encoder (depth estimation) + neural feedforward SMPL mapping. Hỗ trợ TensorRT để tăng tốc thêm trên GPU nếu cần.

Số liệu đáng chú ý

| Metric | SAM 3D Body (gốc) | Fast SAM 3D Body |

|---|---|---|

| End-to-end speedup | baseline | 10.25x |

| SMPL conversion speedup | baseline | 10,000x+ |

| Latency/frame (RTX 5090) | ~660ms (ước tính) | ~65ms |

| LSPET benchmark | baseline | Vượt trội |

| License | Meta (restricted) | MIT |

Điều đáng chú ý: tốc độ tăng nhưng chất lượng không giảm. Fast SAM 3D Body đạt hoặc vượt chất lượng SAM 3D Body gốc trên cả ba benchmark 3DPW, EMDB, và LSPET - không phải trade-off mà là win-win.

Trong thực tế: robot humanoid Unitree G1

Ứng dụng flagship của framework là hệ thống teleoperation vision-only cho robot humanoid Unitree G1 - điều khiển hoàn toàn qua camera, không cần IMU hay thiết bị đeo trên người. Pipeline cực kỳ đơn giản:

- Frame RGB từ camera - đi qua Fast SAM 3D Body (~65ms)

- Nhận joint-level SMPL kinematics của toàn thân

- Lightweight MLP convert sang lệnh điều khiển robot

- G1 thực thi tư thế tương ứng trong thời gian thực

Các tác vụ đã demo thành công: nâng hộp, nhặt và đặt đồ vật, đi tiến/lùi/quay trái phải, quỳ gối các kiểu, ngồi xổm, crouching, giơ tay và cử chỉ tay. 80% task success rate với manipulation policies được huấn luyện từ dữ liệu thu thập qua hệ thống này.

Ý nghĩa thực tế: thu thập dữ liệu imitation learning cho robot trở nên đơn giản hơn nhiều. Người demo chỉ cần đứng trước một camera RGB bình thường - không cần mocap suit đắt tiền, không cần phòng lab đặc biệt.

Giới hạn cần lưu ý

- GPU requirement: cần CUDA-compatible GPU; test chủ yếu trên RTX 5090 - hiệu năng trên GPU tầm trung chưa được benchmark chính thức.

- Phụ thuộc SAM 3D Body: là acceleration framework, không độc lập hoàn toàn - checkpoint gốc vẫn cần download về khi khởi chạy lần đầu.

- Depth từ single RGB: depth được ước tính bằng MoGe encoder, inherently ambiguous - multi-view fusion hỗ trợ nhưng cần nhiều camera hơn.

- Roadmap: chưa có công bố chính thức về hướng phát triển tiếp theo; project đang active trên GitHub.

Nguồn & đọc thêm

Fast SAM 3D Body là ví dụ điển hình cho xu hướng "inference optimization as research" - không cần model mới, chỉ cần hiểu sâu bottleneck của pipeline hiện có là đã mở ra ứng dụng hoàn toàn mới. Với MIT license và code public, đây là điểm khởi đầu tốt cho ai đang làm robotics, motion capture, hay human-computer interaction.

Nguồn: arXiv:2603.15603 | GitHub | Project Page | SAM 3D Body gốc (Meta AI)