- ai4anim-webgpu chạy mạng neural motion matching biped + quadruped trực tiếp trong trình duyệt qua WebGPU, không cần backend hay cài đặt.

- Kernel dùng fp16 weights + fp32 accumulator với 1 GPU dispatch per prediction tick, đạt 30fps mượt.

- Dựa trên nghiên cứu SIGGRAPH 2024 Categorical Codebook Matching của Sebastian Starke và Paul Starke.

- Miễn phí, open-source, CC BY-NC 4.0, 228 stars trên GitHub.

TL;DR

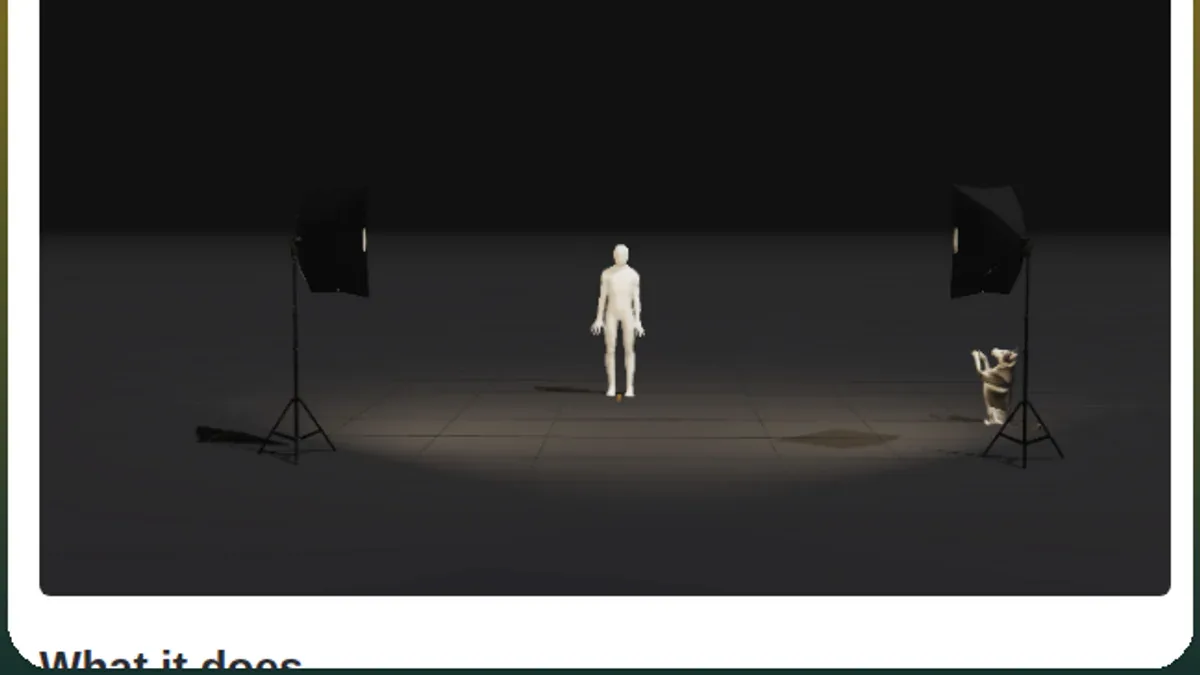

ai4anim-webgpu là một TypeScript/three.js port cho phép chạy neural motion matching - kỹ thuật AI animate nhân vật game thế hệ mới - trực tiếp trong trình duyệt qua WebGPU. Dự án port nguyên các mạng neural biped (người) và quadruped (bốn chân) từ AI4AnimationPy của Facebook Research, bỏ qua hoàn toàn backend server. 228 stars trên GitHub chỉ sau vài ngày ra mắt.

Neural motion matching không phải animation thông thường. Thay vì keyframe cứng nhắc hay blend tree phức tạp, mạng neural học từ hàng giờ mocap data rồi sinh ra chuyển động phù hợp theo thời gian thực - nhân vật tự thích nghi với input của người chơi theo cách trông hoàn toàn tự nhiên. Đây là kỹ thuật đứng sau các game AAA như FIFA và Cyberpunk 2077, nay lần đầu tiên có thể chạy thẳng trong browser.

Vấn đề nó giải quyết

Trước đây, muốn xem thử neural motion matching hoạt động ra sao, bạn phải cài Unity, kéo ONNX model về, hoặc dựng Python environment với NumPy + PyTorch. Quy trình mất ít nhất vài tiếng. Với web developers, ngưỡng entry càng cao hơn - chưa bao giờ có cách nào tích hợp AI animation vào ứng dụng web mà không cần backend nặng nề.

ai4anim-webgpu xóa hoàn toàn rào cản đó. Mở Chrome, vào motionsynth.sweriko.com, dùng WASD để điều khiển nhân vật - xong. GPU của bạn tự xử lý inference, không có server nào tham gia cả.

Với developers muốn tự chạy: npm install && npm run dev là toàn bộ setup cần thiết. TypeScript + Vite + three.js - không có dependency kỳ lạ nào.

Dưới nắp capô

Điểm thú vị về mặt kỹ thuật là cách dự án tối ưu pipeline inference cho môi trường browser:

- Mixed-precision matmul: weights lưu fp16 (bộ nhớ thấp), accumulator fp32 (độ chính xác cao) - cân bằng tốt giữa VRAM và chất lượng.

- Batched compute: chỉ 1 GPU dispatch per prediction tick cho toàn bộ active agents - giảm CPU/GPU round-trip tối đa.

- Shared SkinnedMesh: mọi agent dùng chung 1 instanced

SkinnedMeshthay vì tạo mới - giảm memory overhead đáng kể. - Target framerate: 30fps ổn định trên hardware hiện đại.

Mạng neural nền tảng đến từ bài báo SIGGRAPH 2024 - Categorical Codebook Matching for Embodied Character Controllers của Sebastian Starke, Paul Starke et al. Kỹ thuật codebook matching khớp xác suất phân phối giữa input và output latent spaces, cho phép sinh ra motion tự nhiên từ dữ liệu mocap thô - không cần label thủ công.

Ba thế hệ - một hành trình

| Framework | Môi trường | Gen training data | Setup | Backprop |

|---|---|---|---|---|

| AI4Animation (Unity) | Unity3D + PyTorch | > 4 giờ | > 4 giờ | Không |

| AI4AnimationPy | Python thuần | < 5 phút | ~10 phút | Có |

| ai4anim-webgpu | Browser/WebGPU | Không hỗ trợ | 0 phút | Không |

Hành trình từ SIGGRAPH 2017 (Phase-Functioned Neural Networks) qua 7 năm nghiên cứu liên tục đến SIGGRAPH 2024 'Categorical Codebook Matching for Embodied Character Controllers'. Kỹ thuật codebook matching của bài báo SIGGRAPH 2024 giải quyết bài toán ambiguity trong motion generation - thay vì output một chuyển động duy nhất, model khớp xác suất phân phối giữa hai categorical codebooks để sinh ra motion đa dạng, tự nhiên hơn từ dữ liệu mocap thô.

Ai nên thử ngay

- Web game developers: tích hợp character controller AI-driven vào browser game mà không cần server backend.

- Metaverse / WebXR builders: map user motion lên embodied avatar real-time - upstream framework đã hỗ trợ Quest 2/3 three-point tracking.

- Researchers muốn demo online: thay vì yêu cầu peer cài Unity hay Python, chỉ cần gửi một link.

- Technical artists muốn khám phá: AI-driven animation trong three.js - không cần học game engine mới.

Giới hạn cần biết

- Chỉ là inference port - không train model, không xử lý mocap data mới.

- Control interface còn đơn giản (WASD only), chưa có VR input hay joystick phức tạp.

- Yêu cầu WebGPU-capable browser: Chrome 113+, Firefox 118+, Safari 18+. Không chạy được trên browser cũ hoặc thiết bị không hỗ trợ WebGPU.

- License CC BY-NC 4.0 - chỉ phi thương mại. Không dùng trong sản phẩm commercial.

- Không affiliated với Meta hay nhóm tác giả gốc.

Tiếp theo

Upstream AI4AnimationPy đang phát triển thêm physics simulation (rigid bodies + collision), path planning, và audio support. Khi các tính năng này hoàn thiện, rất có thể sẽ có thêm web port tiếp theo.

Trong ngắn hạn, ai4anim-webgpu mở ra câu hỏi thú vị: nếu inference neural motion matching đã chạy mượt trong browser, liệu chúng ta có thể thấy AI-driven NPC trong web game mainstream không? Câu trả lời có vẻ đang đến gần hơn bao giờ hết.

Nguồn: sweriko/ai4anim-webgpu, facebookresearch/ai4animationpy, sebastianstarke/AI4Animation.