- Mohamed Oumoumad — đồng tác giả paper LumiVid và CTO Gear Productions — vừa tung LoRA cá nhân chuyển ảnh SDR sang HDR scene-linear ngay trong ComfyUI, kèm workflow và grading node.

- Đây là bản port của kỹ thuật LogC3 latent alignment vốn dùng cho video LTX-2.3 sang model edit ảnh Qwen Edit 2509.

TL;DR

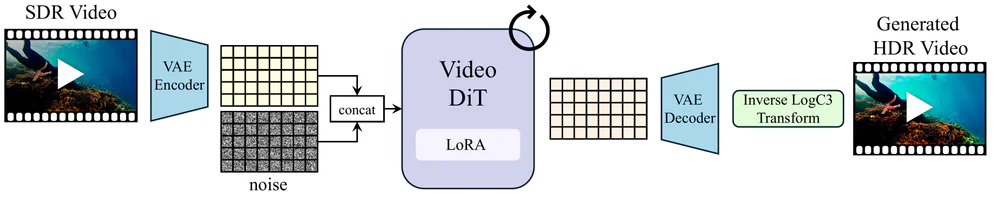

Mohamed Oumoumad (@MedOumoumad) — đồng tác giả paper LumiVid và CTO Gear Productions — vừa public một LoRA cá nhân train trên Qwen Image Edit 2509 để chuyển ảnh SDR sang HDR scene-linear ngay bên trong ComfyUI. Bộ release gồm LoRA weights, workflow ComfyUI và một grading node tự viết. Kỹ thuật bên dưới chính là nguyên lý LumiVid (paper arXiv 2604.11788) đã được Lightricks dùng cho video LTX-2.3 — nay được port sang domain ảnh tĩnh.

What's new

Trước nay muốn có ảnh HDR từ AI thường phải chấp nhận output 8-bit SDR rồi tự stretch contrast — kết quả là vùng highlight bị clip, vùng shadow bị crush, không còn đất để colorist làm việc. LoRA mới của Mohamed giải quyết điểm này theo cách khác hẳn: nó reshape phân phối latent để decoder của Qwen Edit 2509 phát ra giá trị scene-linear, mở thẳng vào pipeline grading như một plate LogC.

- Train trên Qwen Image Edit 2509 (model edit ảnh phổ biến nhất của Alibaba 2026)

- Đầu ra: scene-linear, float-precision, sẵn sàng cho DaVinci Resolve / Nuke / Flame

- Bundle kèm: workflow ComfyUI + grading node tự viết để chơi color wheel ngay trong UI

- Free release qua tweet, không paywall

Why it matters

Đây là lần đầu tiên kỹ thuật latent alignment với logarithmic encoding — vốn được Lightricks giữ ở model video LTX-2 — được port sang một image-edit model open-weight chạy được trên GPU consumer. Trước đó nếu muốn HDR thật từ AI, bạn phải chạy IC-LoRA HDR của Lightricks trên LTX-2.3 (22B params, video). Giờ chỉ cần Qwen Edit 2509 + LoRA này là đủ cho still image, VRAM yêu cầu thấp hơn nhiều bậc.

"When I first saw we could truly push colors that far with LTX, I loaded its EXR sequence in DaVinci Resolve and started playing with the color wheels." — Mohamed Oumoumad, CTO Gear Productions

Technical facts

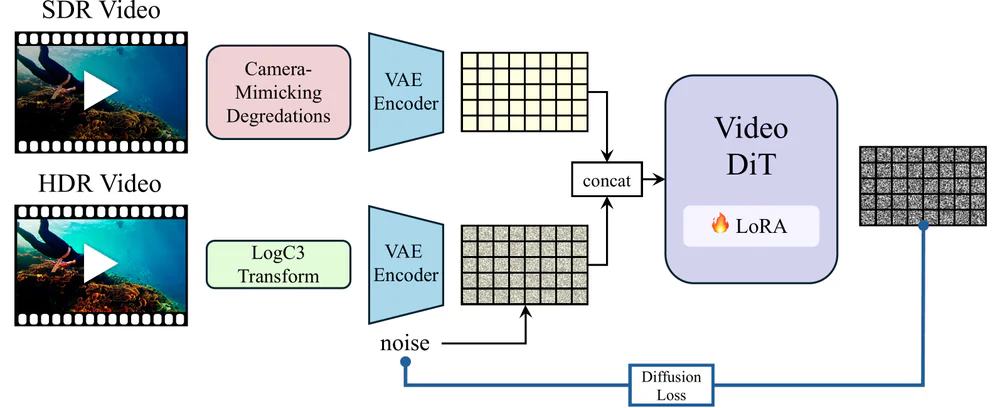

Phương pháp gốc trong paper LumiVid (Naomi Ken Korem, Mohamed Oumoumad et al., Lightricks × Tel Aviv University) gồm 3 thành phần chính:

- LogC3 encoding: dùng curve log từ pipeline ARRI ALEXA để map giá trị HDR không bị bound vào không gian latent vốn được train trên ảnh SDR. Phân phối tự nhiên trùng nhau, không cần redesign VAE.

- LoRA < 1% params: VAE và DiT giữ nguyên frozen, chỉ adapter LoRA được train. Đây là lý do bộ weights nhẹ và cộng đồng port được nhanh.

- Camera-mimicking degradations: phía SDR khi train được làm hỏng đúng cách camera thật làm hỏng signal (clipping, quantization, noise). Model học cách infer chi tiết bị mất, không chỉ stretch contrast.

Comparison

| Cách tiếp cận | Output | Điểm yếu |

|---|---|---|

| Inverse tone mapping cổ điển (Reinhard, X2HDR) | Stretch contrast, không tạo chi tiết mới | Highlight bị clip vẫn trắng |

| Qwen Edit 2509 + prompt "make it HDR" | 8-bit SDR, chỉ tăng contrast cảm tính | Không gradable trong NLE |

| Lightricks LTX-2.3 IC-LoRA HDR (video) | 16-bit EXR scene-linear, video | Cần ~22B params, VRAM cao |

| Qwen Edit 2509 + LoRA này | Scene-linear, gradable, ảnh tĩnh | Single-image, không phải video |

Use cases

- VFX integration: drop ảnh AI vào timeline Resolve cạnh plate live-action mà vẫn còn đủ latitude để grade highlight.

- Virtual production / LED wall: Magnopus đã dùng phiên bản video cho LED wall — bản image LoRA này hợp với previs và matte painting tĩnh.

- Practice color grading: ai muốn tập kéo color wheel trên ảnh AI như đang grade một plate LogC.

- Photo cho HDR display: output đủ data cho HDR10 / Dolby Vision thay vì chỉ rec.709.

Limitations & pricing

- Free: LoRA cá nhân, workflow và grading node đều public. Cần ComfyUI + weights Qwen Image Edit 2509.

- Single-image only: muốn HDR video phải dùng Lightricks/LTX-2.3-22b-IC-LoRA-HDR (LTX-2-community-license).

- Không phải magic: vùng đã clip hoàn toàn (trời trắng, da cháy 100%) sẽ được model tái tạo plausible chứ không phục hồi pixel thật.

- License: Qwen Edit 2509 base có terms riêng — kiểm tra release page LoRA trước khi dùng commercial.

What's next

Cộng đồng nhiều khả năng sẽ port kỹ thuật này sang các image-edit model khác (Flux2 Klein, Z-Image), và sẽ có ComfyUI native node cho LogC3 transform thay vì phải dùng grading node riêng. Lightricks cũng vừa tích hợp LTX HDR vào sản xuất thật — short film ChikaBOOM! được chọn vào Tribeca chính là phim đầu tiên ship bằng pipeline này. Image LoRA của Mohamed hôm nay là cây cầu để cộng đồng indie thử nghiệm cùng nguyên lý mà không cần GPU cluster.

Nguồn: tweet @MedOumoumad, hdr-lumivid.github.io, arXiv 2604.11788, LTX blog, Hugging Face.