- PaperTalker - hệ thống multi-agent từ NUS - tự động tạo video presentation từ paper LaTeX với chi phí $0.001/video.

- Đạt PresentQuiz 84.2%, vượt human-made 10%.

- Mã nguồn mở MIT, chấp nhận tại NeurIPS 2025 Workshop.

- Yêu cầu GPU 48GB VRAM để self-host.

TL;DR

Paper2Video là hệ thống AI mã nguồn mở từ Show Lab (NUS) có thể tự động biến một bài báo khoa học thành video presentation hoàn chỉnh - gồm slide, giọng nói của tác giả, avatar nói chuyện và con trỏ chuột động - chỉ với chi phí $0.001/video. Được chấp nhận tại NeurIPS 2025 Workshop, đạt 2,200+ GitHub stars ngay sau khi ra mắt.

Vấn đề muôn thuở của nhà nghiên cứu

Mỗi bài báo khoa học được chấp nhận tại hội nghị đều kèm theo một yêu cầu không được viết ra: bạn phải làm video presentation. Và đây không phải chuyện nhỏ - thiết kế 16 slide, quay lại, chỉnh sửa, render - dễ mất cả ngày cho một video 6 phút.

Với hàng chục nghìn bài báo được publish mỗi năm, đây là bottleneck khổng lồ. Paper2Video ra đời để xóa bỏ bottleneck đó.

Dự án đến từ Show Lab - nhóm nghiên cứu thuộc National University of Singapore (NUS), nơi đã cho ra đời nhiều công trình nổi tiếng trong lĩnh vực video generation và multimodal AI. Paper2Video không chỉ là một tool - đây còn là benchmark đầu tiên gồm 101 cặp paper-video do chính tác giả tạo, kèm 4 metric đánh giá mới được thiết kế riêng cho bài toán này.

PaperTalker hoạt động như thế nào

Hệ thống dùng kiến trúc 4-agent song song, mỗi agent chuyên một nhiệm vụ:

- Slide Builder - dùng LLM (GPT-4.1 hoặc Gemini 2.5 Pro) để sinh code LaTeX Beamer. Module "Tree Search Visual Choice" tạo nhiều variant layout, render, rồi dùng VLM chọn layout đẹp nhất - giải quyết vấn đề LLM không nhạy cảm với font-size và spacing.

- Subtitle Builder - tạo phụ đề theo từng câu với visual-focus prompts, căn chỉnh thời gian qua VLM.

- Talker Builder - tổng hợp giọng nói cá nhân hóa qua F5-TTS, dựng talking-head avatar qua Hallo2 hoặc FantasyTalking.

- Cursor Builder - xác định vị trí con trỏ trên slide qua UI-TARS (computer-use model) + WhisperX để đồng bộ với lời thoại.

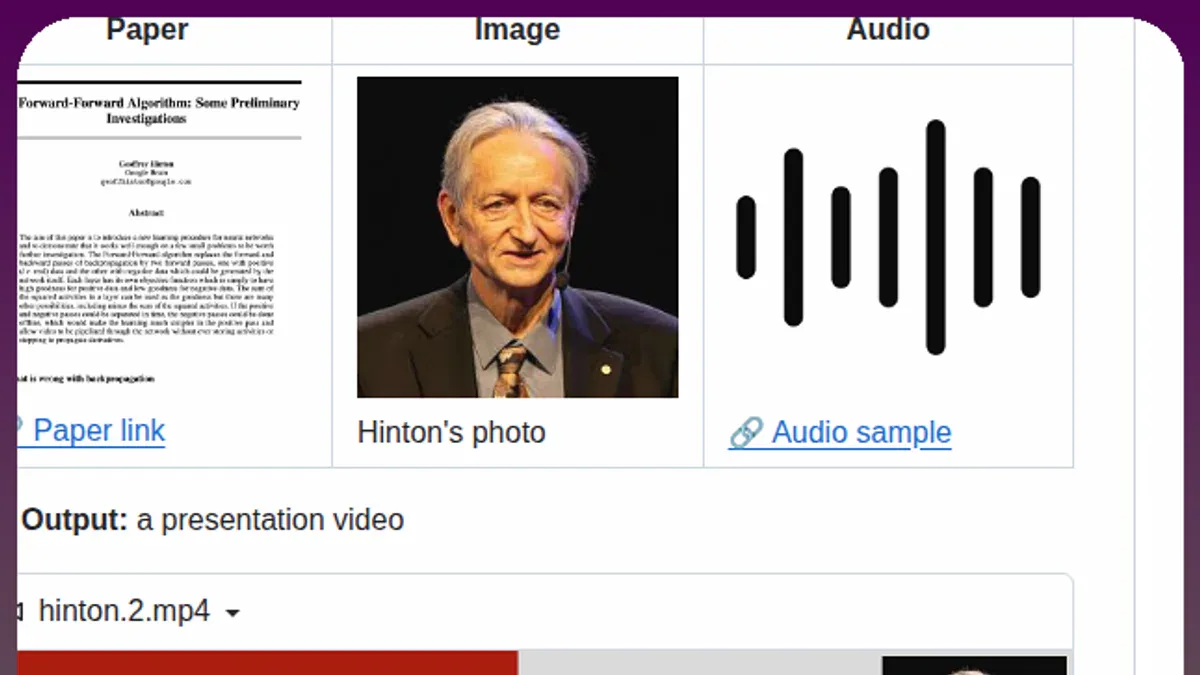

Input cần có: file LaTeX của bài báo + ảnh chân dung tác giả + clip âm thanh tham chiếu. Output: video ~6 phút với slide + giọng nói + avatar + con trỏ.

Con số đáng chú ý

| Chỉ số | Giá trị |

|---|---|

| Chi phí API/video | $0.001 (vs $1.667 của Veo3 - rẻ hơn 1,667 lần) |

| PresentQuiz accuracy | 84.2% - vượt human-made 10% |

| Tốc độ sinh | ~48 phút/video (nhanh hơn 6x so với sequential) |

| Số slide trung bình | 16 slide, dài ~6 phút 15 giây |

| GitHub stars | 2,200+ ngay sau khi ra mắt |

| Benchmark | 101 paper-video pairs (ML/CV/NLP conferences) |

Đặc biệt ở metric PresentQuiz - đo lường mức độ khán giả hấp thu thông tin sau khi xem video - PaperTalker đạt 84.2% trong khi video do con người làm chỉ đạt 73.8%. Lý do: hệ thống cover toàn bộ nội dung một cách có hệ thống, không bỏ sót phần nào như người trình bày vẫn hay làm khi "cắt bớt cho gọn".

So sánh với các công cụ khác

| Tính năng | Veo3 | PresentAgent | PaperTalker |

|---|---|---|---|

| Slide | Không | Có | Có |

| Phụ đề | Không | Có | Có |

| Con trỏ chuột | Không | Không | Có |

| Talking head | Có | Không | Có |

| Chi phí/video | ~$1.667 | N/A | $0.001 |

Các mô hình end-to-end như Veo3 không xử lý được nội dung học thuật dày đặc (bảng số, công thức toán, nhiều hình). PaperTalker được thiết kế riêng cho loại nội dung này.

Giới hạn cần biết

- Yêu cầu LaTeX source - không hoạt động với bài báo chỉ có PDF. Đây là hạn chế lớn nhất với nhiều ngành ngoài ML/CV/NLP.

- Phần cứng nặng - cần NVIDIA A6000 (48GB VRAM) để self-host. Không có dịch vụ cloud chính thức.

- ~48 phút/video - dù đã song song hóa, vẫn chưa phù hợp cho workflow cần kết quả nhanh.

- Con trỏ tĩnh - mỗi câu phụ đề chỉ có một vị trí con trỏ cố định, chưa có chuyển động liên tục.

- Metadata tác giả bắt buộc (ảnh + audio) để dùng talking-head mode. Nếu không cần avatar, dùng

pipeline_light.pyđể chạy nhanh hơn.

Ai nên dùng ngay

- Researcher nộp hội nghị - tạo video presentation trong vài giờ thay vì vài ngày.

- Ban tổ chức hội nghị - batch-generate preview video cho tất cả paper được chấp nhận.

- Lab và trường đại học - tự động hóa việc phổ biến nghiên cứu qua social media với video nhất quán.

- Science communicator - tạo explainer video từ bài báo arXiv mà không cần liên hệ tác giả gốc (dùng light mode).

Nguồn & tài nguyên

Paper2Video hoàn toàn mã nguồn mở: code theo MIT License, dataset 101 paper-video pairs theo CC-BY-SA 4.0 trên HuggingFace (ZaynZhu/Paper2Video). Bài báo được chấp nhận tại NeurIPS 2025 Scaling Environments for Agents Workshop (tháng 10/2025).