- NVIDIA vừa open-source Lyra 2.0 - framework biến một tấm ảnh tĩnh thành thế giới 3D khổng lồ, có thể đi bộ xuyên qua, xuất ra 3D Gaussians, mesh và nạp thẳng vào Isaac Sim cho robot.

- 14B params, huấn luyện trên 32 node H100.

TL;DR

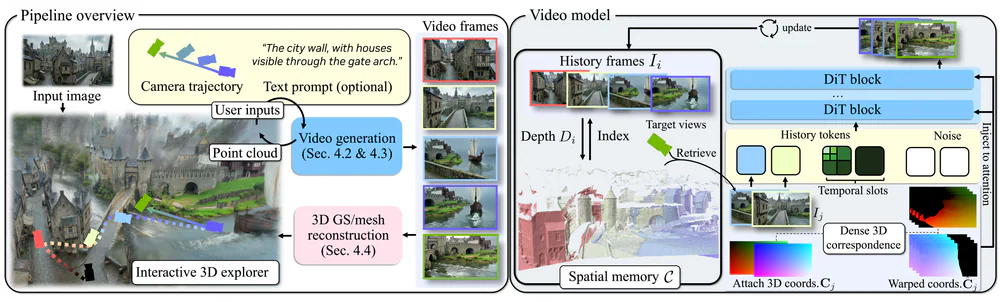

Ngày 14/04/2026, NVIDIA Spatial Intelligence Lab (Toronto) mở mã nguồn Lyra 2.0 - hệ thống biến một tấm ảnh duy nhất thành một thế giới 3D quy mô lớn, có thể đi bộ xuyên qua, quay đầu, ghé lại điểm cũ mà hình học không bị vỡ. Output xuất ra dưới dạng 3D Gaussian Splats (.ply) và mesh, nạp thẳng vào real-time renderer hay physics engine như NVIDIA Isaac Sim.

Lyra 2.0 đã leo lên mức state-of-the-art mới cho bài toán single-image 3D scene generation, và đặc biệt là framework mở đầu tiên cho phép bạn thả robot vào thế giới sinh bởi AI rồi huấn luyện nó.

What's new

Lyra 1.0 ra tháng 9/2025 đã làm được feed-forward 3D reconstruction từ một ảnh, nhưng chỉ dừng ở scene tĩnh, góc nhìn hẹp, không quay đầu lại được. Lyra 2.0 giải hai bài toán khó mà mọi model sinh video dài đều gặp phải:

Spatial forgetting - khi camera đi xa rồi quay lại, model thường bịa ra hình học khác. Lyra 2.0 duy trì per-frame 3D geometry và dùng nó để route thông tin, tra về khung hình quá khứ và thiết lập tương ứng không gian thực sự.

Temporal drifting - lỗi tích lũy theo thời gian. Lyra 2.0 dùng self-augmented training: cho model nhìn chính output bị drift của nó trong khi học, buộc nó phải sửa thay vì lan truyền lỗi.

Kết quả là đoạn walkthrough dài hàng trăm khung hình vẫn nhất quán hình học, và khi dựng thành 3DGS + mesh thì cảnh không vỡ ở chỗ khuất.

Why it matters

Khoảng cách giữa "sinh ảnh đẹp" và "sinh thế giới dùng được" là rất lớn. World model đóng thì có (Google Genie, DeepMind…), nhưng chúng không xuất được sang engine khác. Lyra 2.0 là lần đầu một phòng lab lớn công bố trọng số mở, kèm pipeline xuất thẳng ra .ply Gaussian, mesh, và Isaac Sim. Với robotics, điều này có nghĩa: chỉ cần một tấm ảnh của con phố, xưởng máy, hay căn hộ, bạn đã có môi trường mô phỏng vật lý để train policy - thay vì thuê artist dựng scene hàng tuần.

Technical facts

Property | Giá trị |

|---|---|

Base model | WAN-14B (Diffusion Transformer) |

Params | 14 tỷ |

Input | 1 ảnh 480×832 + 81 camera pose frames |

Output | 3D Gaussian point cloud (.ply) + surface mesh |

Gaussian props | Position, covariance (scale + quaternion), RGB/SH color, α |

Training compute | 32 node H100, ~4,000 iterations, ~24B tokens |

Training data | ~100K image+text pairs có 3D annotation, <10,000 giờ video |

GPU supported | NVIDIA Ampere, Hopper, Blackwell |

Metrics | PSNR, SSIM, LPIPS |

Comparison

So với Lyra 1.0 (09/2025): cùng dòng nhưng khác hẳn khả năng - 1.0 chỉ dựng scene tĩnh, không đi xa được. 2.0 cho phép long-horizon exploration với revisits và góc nhìn lớn.

So với các phương pháp trước như CAT3D, LucidDreamer, Director3D, RealmDreamer: chúng sinh clip ngắn hoặc scene nhỏ, drift mạnh khi camera di chuyển. Lyra 2.0 là hệ thống open-weights đầu tiên thiết kế riêng cho việc ghé lại địa điểm mà không bịa hình học khác.

So với world model đóng (Google Genie 3, DeepMind): cả hai đó không export ra được engine ngoài. Lyra 2.0 mở, xuất thẳng sang Isaac Sim, thả robot thật vào được. Đây là combo mà các đối thủ đóng chưa có.

Use cases

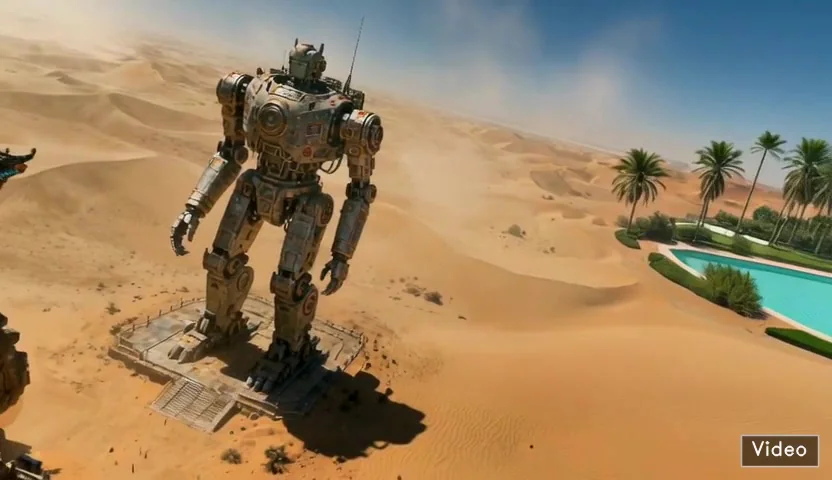

Robotics / embodied AI: sinh môi trường training synthetic cho Isaac Sim chỉ từ 1 bức ảnh. NVIDIA demo luôn: robot giao hàng điều hướng trong scene thành phố sinh ra, và robot tương tác bên trong ngôi đền Trung Hoa do AI dựng.

Game / VR prototyping: từ concept art → scene 3DGS có thể đi dạo trong vài phút.

Film / virtual production: previs location nhanh, không cần on-site scouting.

Research: benchmark cho bài toán long-horizon 3D consistency - vốn khó đánh giá.

Limitations & pricing

Miễn phí tải về, nhưng đọc kỹ license: trọng số Lyra 2.0 dùng NVIDIA Internal Scientific Research and Development Model License - chỉ dùng nghiên cứu, KHÔNG thương mại, không redistribute, không deploy production. Source code trên GitHub thì Apache 2.0, nhưng trọng số mới là phần đắt giá và nó bị khóa chặt hơn một số bài báo ban đầu nói.

Các giới hạn kỹ thuật:

Synthetic data bias - train chủ yếu trên data synthetic, có thể thất bại trên ảnh thật out-of-distribution.

Generalization - các kịch bản ngoài phân phối train sẽ có artifact.

Phần cứng - inference cần GPU class Ampere/Hopper/Blackwell, không chạy trên consumer card dễ dàng.

Chưa có benchmark số công khai ngoài PSNR/SSIM/LPIPS category.

What's next

Nhóm SIL Toronto đã úp mở hướng tiếp theo: world model tương tác real-time, đa người dùng, kết hợp sâu hơn với Isaac Sim để làm platform sinh dữ liệu huấn luyện robot ở quy mô công nghiệp. Lyra 1.0 chỉ cần 7 tháng để nhảy lên 2.0 và sửa hai lỗi kinh niên của video diffusion dài - đà này, phiên bản 3.0 có thể sẽ mở khóa commercial license, hoặc ít nhất là offline-rendering realtime trên RTX Blackwell.

Hiện tại, nếu bạn muốn nghịch thử: clone nv-tlabs/lyra, tải trọng số từ nvidia/Lyra-2.0, và đọc project page.

Nguồn: NVIDIA Research, Hugging Face model card, The Decoder, Glitchwire.