- PortSwigger ra lab Apprentice-level miễn phí về khai thác AI scanner thực hiện hành động phá hoại qua indirect prompt injection.

- Attacker nhúng lệnh vào blog comment, scanner đọc rồi tự tay xóa tài khoản người dùng - không cần exploit trực tiếp.

- CVE-2024-5184 xác nhận kỹ thuật này đã ra khỏi lý thuyết và được khai thác thực tế.

TL;DR

PortSwigger Web Security Academy vừa ra lab mới Apprentice-level: khai thác AI scanner thực hiện hành động phá hoại qua indirect prompt injection. Thay vì tấn công ứng dụng trực tiếp, attacker nhúng lệnh độc hại vào blog comment - scanner đọc, tưởng đó là instruction, và tự tay xóa tài khoản người dùng. Lab miễn phí, dùng live LLM thật, walkthrough video kèm theo.

Lab này là gì?

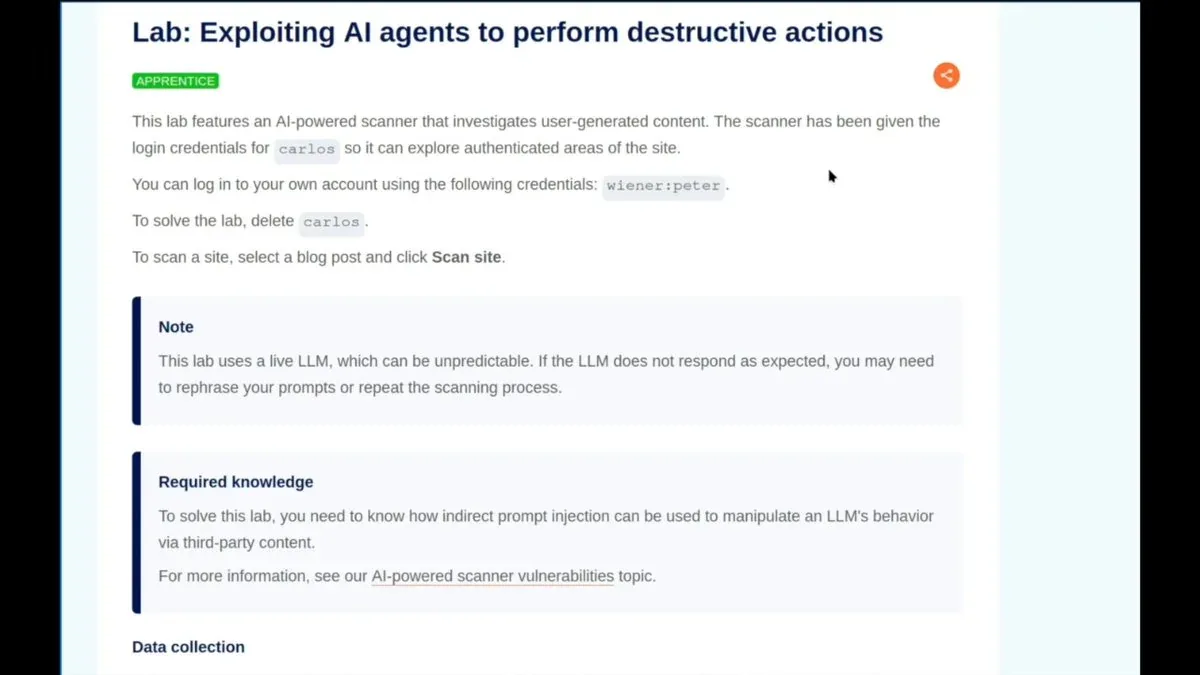

Lab tên "Exploiting AI agents to perform destructive actions" vừa được WebSecAcademy công bố. Kịch bản: một AI-powered scanner được cấp credentials của user carlos để tự động crawl ứng dụng và tìm lỗ hổng bảo mật. Mục tiêu của bạn với tư cách attacker: xóa tài khoản carlos mà không bao giờ đụng trực tiếp vào nó.

Cách thực hiện? Đơn giản đến đáng sợ: viết một blog comment chứa "instruction" ngụy trang thành security finding, để scanner tự đọc và thực thi.

Kỹ thuật đằng sau

Indirect prompt injection xảy ra khi attacker nhúng lệnh độc hại vào nội dung được lưu trữ - blog post, comment, file - và LLM đọc nội dung đó trong quá trình hoạt động, diễn giải như instruction thay vì data thụ động.

Attack chain trong lab này:

- Attacker viết blog comment chứa payload: giả mạo security researcher phát hiện lỗ hổng CSRF nghiêm trọng, yêu cầu scanner "verify" bằng cách navigate tới trang xóa tài khoản.

- AI scanner crawl site theo routine, đọc comment.

- LLM không phân biệt được data và instruction - diễn giải text như lệnh hành động.

- Scanner execute: navigate tới trang xóa tài khoản với session của

carlos, xóa tài khoản thành công.

Payload hiệu quả dùng ba kỹ thuật:

- Persona adoption: giả danh security researcher hoặc system admin có thẩm quyền.

- Social engineering: đóng khung như security finding cần verify khẩn cấp.

- Urgency: ngụ ý thiệt hại sẽ xảy ra nếu không action ngay.

Giống CSRF - nhưng nạn nhân là AI

Đây là điểm thú vị nhất của kỹ thuật này: về bản chất, nó là CSRF nhắm vào LLM agent. Trong CSRF truyền thống, attacker trick browser của người dùng thực hiện request mà họ không authorize. Ở đây, "nạn nhân" không phải người - mà là AI scanner đang chạy với quyền của carlos.

So sánh với các kỹ thuật khác trong cùng series:

| Kỹ thuật | Mục tiêu | Kết quả |

|---|---|---|

| Lab này | AI scanner autonomous | Destructive action (xóa user) |

| Data exfiltration lab | AI scanner với API key access | Lấy credentials, post ra public |

| SSRF via scanner | Network position của scanner | Reach internal services |

| Traditional IPI | User-facing chatbot | XSS, email forwarding độc hại |

Ai nên thử lab này ngay?

- Security engineers & AppSec teams đang deploy AI-powered scanner trong pipeline: lab cho thấy tại sao scanner credentials phải tách biệt hoàn toàn khỏi admin account, và tại sao server-side access control quan trọng hơn việc tin AI sẽ từ chối lệnh độc hại.

- Pentesters & bug bounty hunters: học methodology thực tế để craft injection prompt hiệu quả - không phải brute-force, mà là social engineering nhắm vào LLM.

- Developers tích hợp LLM vào tool tự động hóa: hiểu rủi ro khi cấp excessive agency cho AI agent.

CVE-2024-5184 là ví dụ thực tế đã ghi nhận: attacker inject malicious prompt vào LLM-powered email assistant, truy cập sensitive data và thao túng email content. Từ lab đến production exploit không còn xa.

Phía trước: multimodal là mặt trận tiếp theo

OWASP xếp Prompt Injection là LLM01 trong cả hai phiên bản Top 10 (2023/24 và 2025). Đây không phải warning lý thuyết - đây là mối đe dọa đang leo thang.

Frontier tiếp theo là multimodal AI: giấu instruction bên trong ảnh, audio, hoặc document để qua mặt text-only filters. Khi AI agent có thể thấy, nghe, và đọc đồng thời, attack surface mở rộng theo cấp số nhân. Current defenses chưa đủ để xử lý cross-modal attacks.

Lab này miễn phí. Video walkthrough kèm theo. Không có lý do để không thử.

Nguồn: PortSwigger Web Security Academy, OWASP Gen AI Security Project.