TL;DR

Ngày 2/4/2026, Google DeepMind công bố Gemma 4 — dòng mô hình mở mạnh nhất từ trước đến nay, phát hành dưới giấy phép thương mại Apache 2.0. Bốn biến thể (E2B, E4B, 26B MoE, 31B Dense) được thiết kế để chạy tốt từ Raspberry Pi, điện thoại, cho tới workstation H100. Mô hình 31B xếp hạng #3 thế giới trên Arena AI leaderboard, đánh bại nhiều mô hình mở lớn gấp 20 lần về số tham số. Context tối đa 256K token, hỗ trợ 140+ ngôn ngữ, tích hợp sẵn khả năng suy luận (thinking mode), function calling và xử lý đa phương tiện.

What's new

- 4 kích cỡ: E2B (2.3B effective / 5.1B total), E4B (4.5B / 8B), 26B A4B MoE (3.8B active / 25.2B total), 31B Dense (30.7B)

- Apache 2.0 license — toàn quyền thương mại, chủ quyền dữ liệu

- Context window 256K (26B/31B) và 128K (E2B/E4B)

- Thinking mode có thể bật/tắt bằng token

<|think|> - Đa phương tiện: text + image (mọi kích cỡ), video (mọi kích cỡ, tối đa 60s @ 1fps), audio native (chỉ E2B/E4B, tối đa 30s)

- Function calling native, structured JSON output, system prompt role

- 140+ ngôn ngữ pretrained

- E2B chạy dưới 1.5GB RAM nhờ LiteRT với trọng số 2-bit/4-bit

Why it matters

Đây không còn là cuộc đua "ai có nhiều tham số hơn." Gemma 4 đặt cược vào intelligence-per-parameter: mô hình 31B vượt mặt các mô hình mở gấp 20 lần kích thước. Với Apache 2.0, developer và doanh nghiệp có thể triển khai local, offline, on-prem hoặc bất kỳ cloud nào — không còn phụ thuộc vào data center siêu lớn để có AI frontier-level.

Dịch sang ngôn ngữ thực tế: bạn có thể chạy agent tự quản, tự gọi tool, tự xử lý video + audio ngay trên điện thoại Android hoặc Raspberry Pi, hoàn toàn offline, không gửi dữ liệu đi đâu.

Technical facts

| Property | E2B | E4B | 26B A4B MoE | 31B Dense |

|---|---|---|---|---|

| Params (effective/total) | 2.3B / 5.1B | 4.5B / 8B | 3.8B active / 25.2B | 30.7B |

| Context | 128K | 128K | 256K | 256K |

| Vocab | 262K | 262K | 262K | 262K |

| Modalities | Text+Image+Audio | Text+Image+Audio | Text+Image | Text+Image |

Kiến trúc dùng xen kẽ sliding-window attention và global full-context, Per-Layer Embeddings (PLE) phụ vào từng decoder layer, và Shared KV Cache giảm tính toán dư thừa. 31B bfloat16 chạy gọn trên một GPU NVIDIA H100 80GB; trên Raspberry Pi 5 CPU mô hình nhỏ đạt 133 prefill / 7.6 decode token/s, trên Qualcomm Dragonwing IQ8 NPU đạt 3,700 prefill / 31 decode token/s.

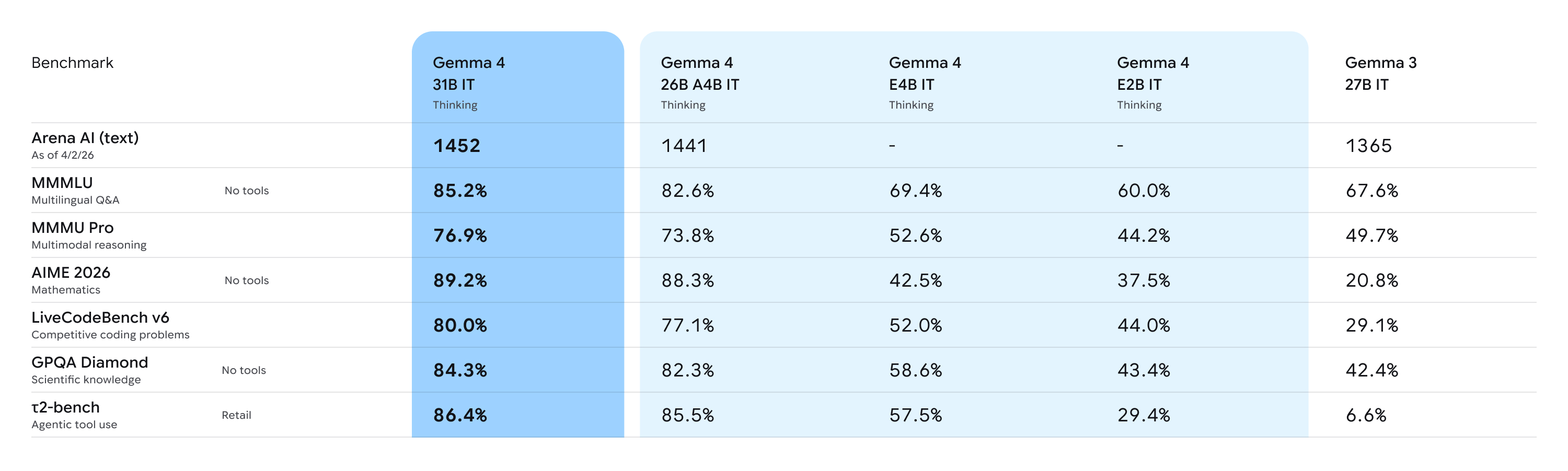

Comparison vs Gemma 3

Những con số sau là mức nhảy vọt hiếm thấy giữa hai thế hệ (Gemma 4 31B vs Gemma 3 27B):

- AIME 2026 math: 20.8% → 89.2%

- LiveCodeBench v6: 29.1% → 80.0%

- Codeforces ELO: 110 → 2150

- GPQA Diamond: 42.4% → 84.3%

- τ2-bench agentic retail: 6.6% → 86.4%

- MRCR v2 128K long-context recall: 13.5% → 66.4%

- Arena AI: 1365 → 1452

Trên Arena AI leaderboard của mô hình mở: 31B = #3 thế giới, 26B MoE = #6.

Use cases

- On-device agents — Google AI Edge Gallery ra mắt "Agent Skills" chạy toàn bộ trên thiết bị (query Wikipedia, ghép ảnh với nhạc, chú thích tiếng kêu động vật)

- Offline coding assistant trên workstation (31B ELO Codeforces 2150)

- Tóm tắt + flashcards + biểu đồ từ văn bản, video, giọng nói

- OCR đa ngôn ngữ, object detection, GUI detection — model trả bounding box dạng JSON thẳng, không cần grammar

- Speech recognition + speech translation offline trên E2B/E4B

Limitations & pricing

Giá: miễn phí. Apache 2.0, dùng thương mại thoải mái.

Knowledge cutoff: tháng 1/2025 — không biết sự kiện mới hơn.

Hạn chế thừa nhận: có thể tạo ra sự thật sai/lỗi thời, khó với sarcasm và ẩn dụ, thiếu common sense ở một số tình huống, hiệu năng phụ thuộc prompt và ngữ cảnh đủ rõ.

Tải ở đâu: Hugging Face, Kaggle, Ollama, LM Studio, Docker. Thử trực tiếp: Google AI Studio (31B, 26B) hoặc Google AI Edge Gallery app (E2B, E4B).

What's next

Android developers được khuyến khích prototype agentic flow qua AICore Developer Preview ngay hôm nay — bản preview này forward-compatible với Gemini Nano 4 sắp ra. Google cũng mở Gemma 4 Good Challenge trên Kaggle cho các ứng dụng tạo tác động xã hội tích cực.

Nguồn: blog.google, DeepMind, Google Developers Blog.