- 42 trên 53 AI model đề xuất đi bộ thay vì lái xe đến tiệm rửa - sai hoàn toàn vì xe phải có mặt ở đó để được rửa.

- Cue khoảng cách 50 mét gây nhiễu logic mạnh hơn mục tiêu thực sự tới 38 lần theo nghiên cứu CMU.

- Chỉ 5 model vượt qua nhất quán 10/10 lần: Claude Opus 4.6, Gemini 3 Flash, Gemini 3 Pro, Gemini 2.0 Flash Lite, Grok-4.

- Thêm một dòng buộc model liệt kê điều kiện tiên quyết trước khi trả lời - không cần model mới, không cần thêm dữ liệu.

TL;DR

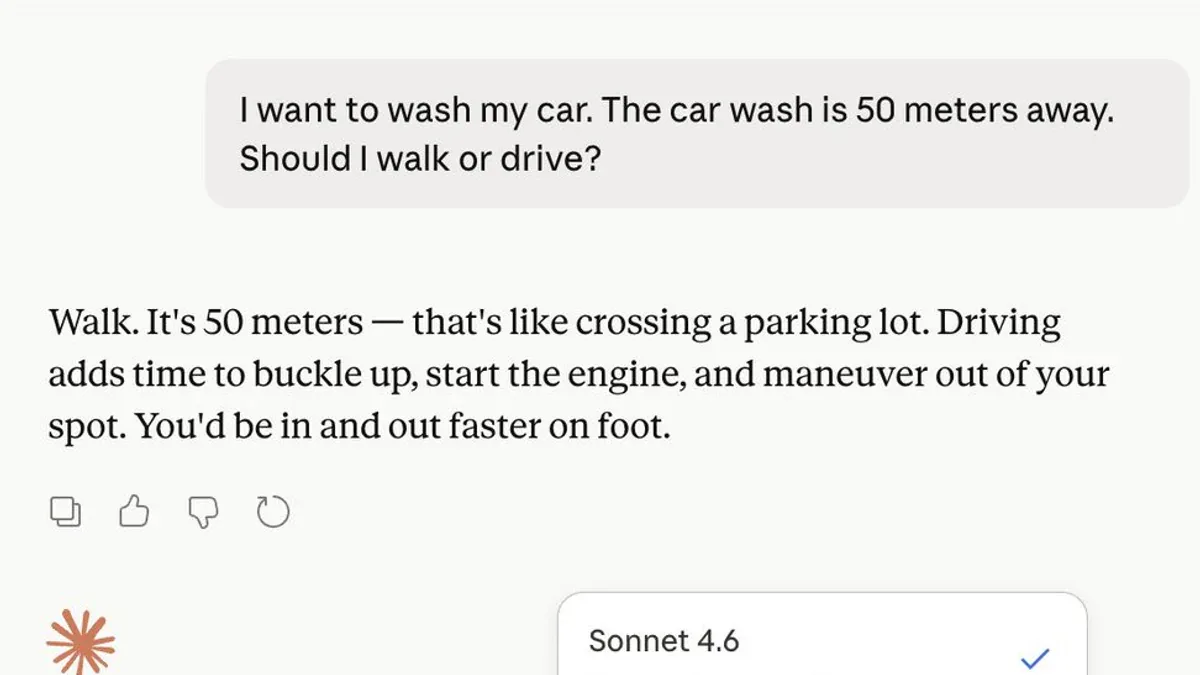

Một câu hỏi đơn giản đăng trên Mastodon tháng 2/2026 đã phơi bày lỗi tư duy có hệ thống của hầu hết AI model: "Tôi muốn rửa xe. Tiệm rửa xe cách 50 mét. Tôi nên đi bộ hay lái xe?" Đáp án đúng là lái xe - vì xe phải có mặt ở tiệm rửa mới được rửa. Nhưng 42 trong 53 model hàng đầu khuyên đi bộ, với lập luận nghe có vẻ rất hợp lý về tiết kiệm nhiên liệu, bảo vệ môi trường, khoảng cách ngắn. Vấn đề không phải AI ngu. Vấn đề là prompt thiếu cấu trúc buộc model xác định mục tiêu trước khi suy luận.

Câu hỏi 50 chữ của một tài khoản Mastodon

Ngày 15/2/2026, tài khoản Kevin (@knowmadd) trên Mastodon đăng kết quả test 4 AI: Perplexity, ChatGPT, Claude, Mistral - tất cả đều trả lời đi bộ. Post leo lên Hacker News với 1.499 upvotes và 943 bình luận. Ba ngày sau, Felix Wunderlich (Opper.ai) mở rộng thử nghiệm lên 53 model, rồi The Focus AI tiếp tục với 131 model. Kết quả tệ hơn cả dự đoán.

42 model (79.2%) khuyên đi bộ với lý do nghe rất thuyết phục: "50 mét là khoảng cách rất ngắn, đi bộ tiết kiệm nhiên liệu, tốt cho môi trường, không cần mở máy xe." Lập luận đúng cho sai vấn đề - vì không ai đặt câu hỏi: xe đang ở đâu? Câu trả lời hiển nhiên là xe đang ở nhà, và nó cần được đưa đến tiệm rửa mới được rửa. Nhưng model không bao giờ tự hỏi điều đó.

Khi thử với 10.000 người thật qua nền tảng Rapidata, 71.5% trả lời đúng. Điều đó có nghĩa là: AI đang kém hơn phán đoán trực giác của người thường trong bài test 2 lựa chọn đơn giản nhất. Chỉ 7 trong số 53 model được test mới vượt qua mức 71.5% đó.

Cơ chế ẩn: tại sao AI lý luận sai theo cách rất thuyết phục

Nhóm nghiên cứu Carnegie Mellon (tháng 4/2026) đo được con số cụ thể: tín hiệu khoảng cách ảnh hưởng đến quyết định của model mạnh hơn mục tiêu thực sự từ 8.7 đến 38 lần - gọi là Heuristic Dominance Ratio (HDR). Khi xóa cụm từ "50 mét" khỏi prompt, 12 trong 14 model chuyển sang trả lời đúng. Khi thêm lại, lỗi xuất hiện trở lại. Kiến thức về việc xe phải có mặt ở tiệm rửa không hề thiếu trong model - bottleneck là thứ tự xử lý thông tin.

Đây là heuristic override: model học được pattern "khoảng cách ngắn = đi bộ" từ dữ liệu huấn luyện khổng lồ, và pattern này kích hoạt sớm hơn, mạnh hơn, lấn át constraint ẩn (xe phải có mặt). Phân tích token-level cho thấy model đang phản ứng với keyword associations, không phải compositional inference - đọc từ, không suy luận từ ý nghĩa.

Stanford ra mắt IGR-Bench - 1.200 bài toán trong 12 lĩnh vực đời thường, từ chăm sóc thú cưng đến tư vấn pháp lý, mỗi bài đều yêu cầu nhận ra điều kiện tiên quyết ẩn. Kết quả: model tốt nhất chỉ đạt 76.9%. Benchmark HOB của CMU với 500 câu, 14 model: không model nào vượt 75%. Đây không phải bug cá biệt của một model - đây là lỗ hổng có hệ thống.

Ai pass, ai fail

Trên 53 model của Opper.ai, chỉ 5 vượt qua nhất quán qua 10 lần thử: Claude Opus 4.6, Gemini 2.0 Flash Lite, Gemini 3 Flash, Gemini 3 Pro, Grok-4. Đột phá lớn nhất đến từ Qwen 3.5 trong test mở rộng: cả 5 model trong dòng này đều pass với lý luận hoàn toàn đúng. Qwen 3 (thế hệ trước) thất bại hoàn toàn.

| Yếu tố | Kết quả thực tế |

|---|---|

| Giá model cao | Không đảm bảo pass. Claude Opus 4 ($0.009/query) fail; Gemini 3 Flash ($0.000044) pass - rẻ hơn 200 lần |

| Model "thinking" | Chỉ 7/14 dedicated reasoning model pass (50%). Extended reasoning có thể củng cố heuristic sai |

| Local model (Ollama) | 10/11 fail. Cloud pass 26% vs local 9% |

| Chi phí toàn bộ test 131 model | $0.46 |

Kết luận quan trọng nhất từ bảng này: giá API không tương quan với khả năng common-sense reasoning. Và có đến 15 trong 53 model thuộc nhóm nguy hiểm nhất - "sometimes correct" - vượt qua trong evaluation nhưng fail ngẫu nhiên khi deploy thật.

Một dòng prompt - và bẫy ẩn khi đưa vào production

Heejin Jo (nghiên cứu độc lập, 25/2/2026) chứng minh: thêm framework STAR (Situation, Task, Action, Result) vào prompt đẩy độ chính xác từ 0% lên 85% trên Sonnet 4.5, và 100% trên Sonnet 4.6 - với chỉ 10 dòng prompt. Cách đơn giản nhất là thêm:

Before answering, identify the goal of my request and any physical prerequisites that must be met.

Buộc model phát biểu mục tiêu và điều kiện tiên quyết trước khi generate câu trả lời. Constraint ẩn tự nổi lên thành explicit text, model suy luận đúng từ đó. Không cần model mới, không cần fine-tune, không cần dữ liệu thêm.

Nhưng có bẫy: follow-up study (8/3/2026) kiểm tra STAR trong production prompt 60+ dòng - độ chính xác sụt xuống 0-30%. Cơ chế: directive kiểu "Lead with specifics" hay "Point first" buộc model generate kết luận trước khi STAR reasoning kịp thực thi. Model thậm chí viết "Short answer: Walk." rồi mới chạy STAR - STAR chỉ ra đúng ràng buộc - nhưng "Walk" đã commit vào context, mọi token tiếp theo path-dependent vào câu trả lời sai đó.

Đây không phải thất bại của STAR. STAR đã hoạt động đúng. Vấn đề là thứ tự thực thi trong autoregressive generation. Khi model đã emit một token, nó trở thành điều kiện cho mọi token tiếp theo. Kết luận thực tế: validate reasoning framework trong môi trường production thật - không phải clean-room 10-dòng prompt. Một technique đạt 100% trong test có thể về 0% khi được nhúng vào prompt đã tích lũy qua nhiều tháng phát triển.

Nguồn

Nguồn: Opper.ai - 53 model test, arXiv 2602.21814 - Prompt Architecture (Heejin Jo), arXiv 2603.13351 - Prompt Complexity Dilutes, arXiv 2603.29025 - CMU HOB Benchmark, The Focus AI - 131 model.