- Đa số người dùng LLM dừng ở zero-shot — gõ câu hỏi, nhận câu trả lời, xong.

- Nhưng khi output không đủ tốt, fix đầu tiên không phải nâng model mà là sửa prompt.

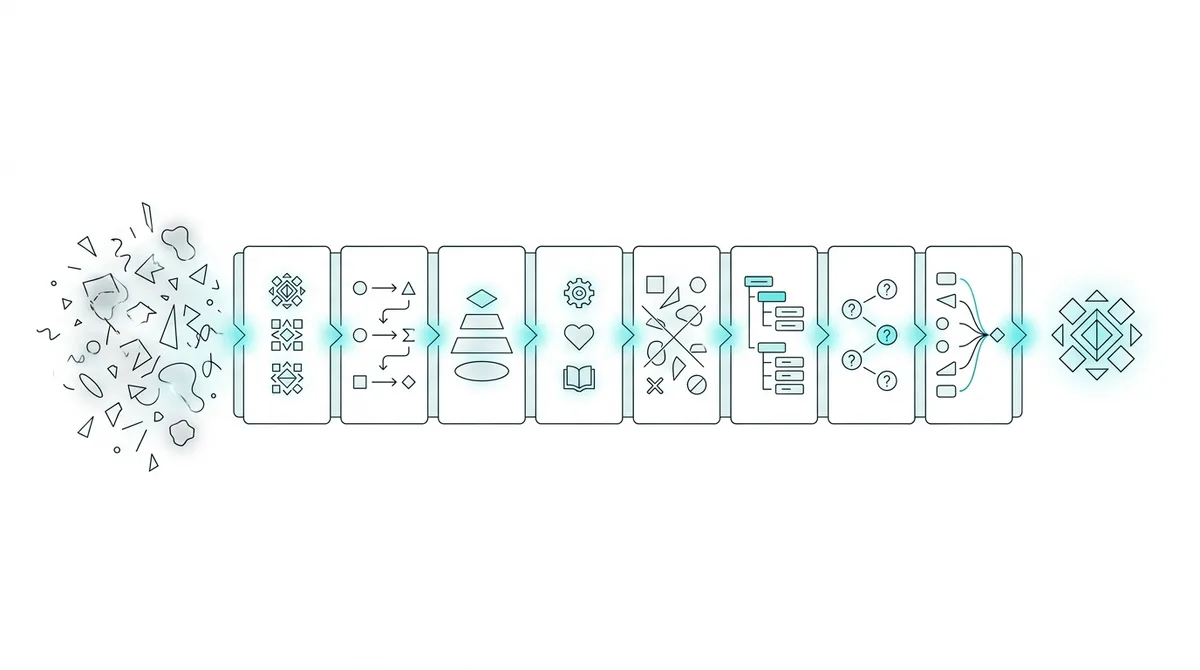

- Đây là 8 kỹ thuật prompting đáng dùng năm 2026, gồm cả ARQ (90.2% tuân thủ chỉ dẫn) và Verbalized Sampling (đa dạng tăng 2x).

TL;DR

Zero-shot prompting (hỏi và nhận) là baseline — ai cũng làm được, nhưng cũng là điểm output yếu nhất. Trước khi đổi sang model lớn hơn, hãy thử 8 kỹ thuật prompting bên dưới.

Tất cả đều chỉ thay đổi prompt, không cần đổi model, không cần infra mới, không cần thêm chi phí ngoài input token. Đáng chú ý nhất: ARQ đạt 90.2% tuân thủ chỉ dẫn vs 81.5% của direct prompting, và Verbalized Sampling tăng đa dạng output 1.6–2.1×.

Bài viết này có gì mới?

Bài tổng hợp gốc của Avi Chawla (Daily Dose of DS) được lấy cảm hứng từ một bản nổi tiếng của ByteByteGo, nhưng cập nhật lại với 3 kỹ thuật mới dựa trên nghiên cứu 2025: ARQ, Verbalized Sampling, và JSON prompting.

Đồng thời bỏ zero-shot ra khỏi danh sách vì nó không phải kỹ thuật — nó là baseline mặc định mà ai cũng đang làm.

Điểm cốt lõi: khi output kém, đa số phản xạ là "đổi sang GPT mạnh hơn" hoặc "chờ Claude version mới". Nhưng prompting tốt hơn thường rẻ, nhanh, và hiệu quả hơn — đặc biệt khi bài toán không cần thêm năng lực, mà cần thêm cấu trúc.

8 kỹ thuật và con số đi kèm

1. Few-shot prompting. Đưa 3–5 cặp ví dụ input→output ngay trong prompt. Model học pattern và áp dụng vào input mới. Hợp với task có format chặt như NL→SQL, phân loại văn bản.

2. Chain-of-Thought (CoT). Yêu cầu model suy luận từng bước trước khi đưa kết quả. Câu "Let's think step by step" nâng độ chính xác trên benchmark GSM8K của PaLM-540B từ 17.7% lên 78.7%. Hợp với toán, debug code, lý luận đa bước.

3. Prompt hierarchy. Tận dụng nhiều cấp độ prompt (system / developer / user) với mức quyền khác nhau. Cấp cao override cấp thấp. Dùng để đặt ràng buộc bất biến mà user input không phá được.

4. Role-specific prompting. Gán persona cho model: "Bạn là một nhà nghiên cứu bảo mật". Model sẽ điều kiện hóa output trên một lát cắt khác của training data — từ vựng khác, prior khác, góc nhìn khác.

5. Negative prompting. Nói rõ điều model KHÔNG được làm. "Không dùng giọng marketing", "không nhắc giá trừ khi được hỏi". Hoạt động như một hard constraint, không phải gợi ý mềm.

6. JSON prompting. Định nghĩa schema JSON ngay trong prompt, model trả output đúng format. Báo cáo cho thấy ~90%+ schema compliance trên các model đủ năng lực, không cần API setup riêng. Lý tưởng cho pipeline có downstream parser.

7. Attentive Reasoning Queries (ARQ). Thay free-form CoT bằng một "reasoning blueprint" — schema JSON gồm các câu hỏi domain-specific mà model phải trả lời trước khi output. Paper arXiv 2503.03669 (Karov, Zohar, Marcovitz; tháng 3/2025) báo cáo trên 87 kịch bản test:

Kỹ thuật | Tỷ lệ thành công | Re-apply guideline |

|---|---|---|

Direct prompting | 81.5% | 85.31% |

Chain-of-Thought | 86.1% | 87.81% |

ARQ | 90.2% | 92.19% |

ARQ cũng giảm hallucination 23% so với CoT. Sinh ra từ Parlant — framework xây dựng customer-facing agent đáng tin cậy.

8. Verbalized Sampling (VS). Prompt model sinh nhiều câu trả lời kèm xác suất: "Tạo 5 truyện cười về cà phê và xác suất tương ứng".

Khi bị buộc phải "mô tả phân phối" thay vì "sample từ phân phối", model bypass được hiệu ứng làm phẳng (sharpening) của RLHF. Paper arXiv 2510.01171 (Stanford + Northeastern, tháng 10/2025) báo cáo: đa dạng output tăng 1.6–2.1× trong creative writing, điểm đánh giá của con người tăng 25.7%, vẫn giữ nguyên độ chính xác và safety.

Mode collapse hoá ra không phải lỗi thuật toán — nó là "typicality bias": annotator có xu hướng chọn văn bản quen thuộc, RLHF học theo, model bị thu hẹp về output trung bình.

So với danh sách cũ và với nhau

So với danh sách prompting kiểu cũ (ByteByteGo và các bài tổng hợp 2023–2024): bản 2026 lệch về phía structured + agentic. ARQ và VS đều coi prompt như một chương trình nhỏ chứ không phải một câu hỏi hội thoại.

Các kỹ thuật stack rất tốt:

Few-shot + CoT: ví dụ kèm chuỗi suy luận → model học cả pattern lẫn cách nghĩ.

JSON + Negative prompting: schema chặt + ràng buộc rõ → output ổn định hơn.

ARQ về bản chất là CoT có cấu trúc cho agentic conversation.

VS là người anh em đa dạng hóa của self-consistency — lấy nhiều candidate trong một call thay vì N call.

Khi nào dùng kỹ thuật nào

Few-shot: phân loại, biến đổi format, NL→SQL, trích xuất dữ liệu.

CoT: toán, debug code, lý luận đa bước, mọi task cần biện minh.

Prompt hierarchy: safety guardrail, SaaS multi-tenant nơi user không được override rule admin.

Role-specific: mô phỏng chuyên gia (security review, legal review), so sánh nhiều góc nhìn.

Negative prompting: copywriting tránh sáo rỗng, code generation tránh API deprecated.

JSON prompting: API response, agent tool-calling, ETL có downstream parser.

ARQ: agent đối mặt khách, flow nhiều lượt mà guideline phải duy trì xuyên suốt.

Verbalized Sampling: viết sáng tạo, brainstorm, synthetic data, biến thể dialogue.

Hạn chế & chi phí

Tin tốt: 8 kỹ thuật này chỉ thay đổi prompt. Không nâng cấp model, không thay infra. Chi phí phụ duy nhất là input token nhiều hơn (prompt dài hơn).

Caveat từng kỹ thuật:

Few-shot: tốn context window; chọn ví dụ tệ → model học pattern sai.

CoT: output dài → tốn output token; có thể bị lock vào nhánh suy luận sai.

Prompt hierarchy: phụ thuộc vào provider — system/developer/user role không đồng nhất giữa các API.

JSON prompting: ~90% compliance, không phải 100% — vẫn cần parser + retry path.

ARQ: cần thiết kế schema câu hỏi domain-specific upfront, không plug-and-play.

Verbalized Sampling: model nhỏ benefit ít hơn — xác suất verbalize có thể không có ý nghĩa nếu model yếu.

Và như Avi nhấn mạnh: prompt là cần gạt rẻ nhất, không phải duy nhất. Output tốt hơn còn đến từ context tốt hơn (RAG), tool access, và retrieval.

Hướng đi tiếp theo

Prompting đang chuyển từ "câu thần chú" ("let's think step by step") sang schema có cấu trúc (ARQ) và elicit phân phối (VS). Cả hai đều coi prompt như chương trình. Khi agent loop và tool-calling thành phổ biến, kỳ vọng các kỹ thuật schema-driven kết hợp tool sẽ trở thành mặc định trong stack production — chứ không chỉ là mẹo của power user.

Via: Daily Dose of DS — Avi Chawla, arXiv 2503.03669 (ARQ), arXiv 2510.01171 (Verbalized Sampling).

Đạo hữu là phàm nhân, tu tiên giả

... hay AI cào nội dung?

Tất cả nội dung tại đạo quán đều miễn phí. Đạo hữu chỉ cần nhập email của mình để đọc tiếp. Nói KHÔNG với Spam. Huỷ subcribe lúc nào đạo hữu thích.

nếu không muốn nhận newsletter thì có thể nhập mail phụ